Pourquoi la voix off est décalée de l'image (Lip-sync) et comment réparer

Votre avatar IA parle mais les lèvres ne suivent pas ? Guide complet du lip-sync : pourquoi ça échoue et comment synchroniser parfaitement audio et vidéo.

Votre avatar IA prononce un discours. La voix est parfaite, claire, professionnelle. Mais les lèvres... elles bougent à côté du texte. Parfois en retard, parfois en avance, parfois dans un mouvement qui ne correspond à aucun son humain.

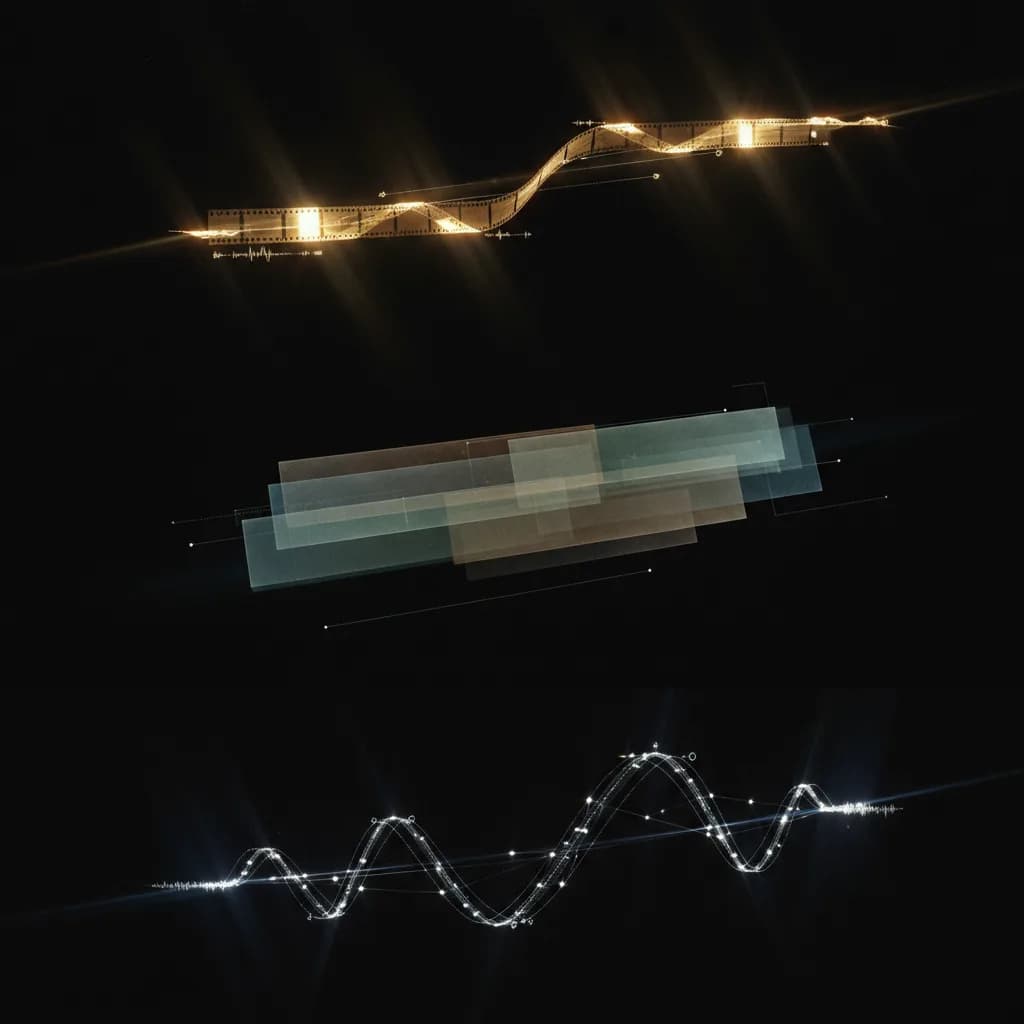

C'est le problème du lip-sync (synchronisation labiale). Faire correspondre les mouvements des lèvres à l'audio est l'un des défis techniques les plus difficiles de la vidéo IA.

Ce guide vous explique pourquoi ça échoue et comment obtenir de meilleurs résultats.

Pour aller plus loin avec une demonstration pratique, cette video est directement liee au sujet.

🎧 Sons & SFX Gratuits avec l’IA : Ne Payez Plus Jamais pour Vos Effets Sonores !

Pourquoi le lip-sync est si difficile

La parole humaine implique des dizaines de muscles faciaux qui bougent de façon coordonnée. Chaque phonème a une forme de bouche spécifique (les "visèmes"). Le timing doit être au dixième de seconde près.

Les générateurs d'avatars IA font un travail probabiliste : ils estiment quels mouvements devraient accompagner quel son. Mais ils n'ont pas la compréhension fine de la phonétique.

Les sources d'erreur :

- Décalage temporel : L'audio et la vidéo ne sont pas alignés au frame près

- Visèmes incorrects : Les formes de bouche ne correspondent pas aux sons

- Transitions abruptes : Les mouvements manquent de fluidité

- Langue mal gérée : Le français est souvent moins bien supporté que l'anglais

Le cerveau humain est extrêmement sensible au lip-sync. Un décalage de 100 millisecondes suffit à créer un malaise, même inconscient.

Les outils de génération avec lip-sync

HeyGen

HeyGen propose des avatars avec lip-sync intégré. La qualité varie selon l'avatar choisi et la langue.

Points forts :

- Nombreux avatars pré-définis

- Support multilingue (dont français)

- Interface simple

Limites :

- Qualité variable selon l'avatar

- Certains accents mal gérés

Synthesia

Synthesia est orienté corporate avec des avatars réalistes.

Points forts :

- Avatars très professionnels

- Bon lip-sync en anglais

- Support pour créer son propre avatar

Limites :

- Prix élevé

- Français correct mais pas parfait

D-ID

D-ID permet d'animer des photos ou illustrations pour les faire "parler".

Points forts :

- Fonctionne avec n'importe quelle image

- Bon pour les personnages stylisés

Limites :

- Le lip-sync sur des images statiques est moins précis

Runway / Luma / Pika (vidéo générative)

Ces outils génèrent de la vidéo, pas du lip-sync dédié. Le lip-sync est approximatif ou absent.

Pourquoi votre lip-sync échoue

Cause 1 : Audio de mauvaise qualité

Si votre fichier audio a du bruit de fond, des variations de volume, ou une compression excessive, l'algorithme de lip-sync a du mal à identifier les phonèmes.

Solution : Utilisez un audio propre. ElevenLabs, PlayHT, ou un enregistrement de qualité. Nettoyez le bruit de fond avec des outils comme Adobe Podcast Enhance.

Cause 2 : Langue non optimisée

La plupart des outils sont optimisés pour l'anglais américain. Le français, avec ses liaisons et ses sons nasaux, pose plus de problèmes.

Solution : Testez la version anglaise d'abord pour voir si c'est un problème de langue. Certains outils proposent des modes "français" spécifiques.

Cause 3 : Avatar inadapté

Certains avatars sont mieux animés que d'autres. Un avatar "premium" aura généralement un meilleur lip-sync qu'un avatar basique.

Solution : Testez plusieurs avatars. Les avatars "réalistes" haut de gamme ont souvent de meilleures animations.

Cause 4 : Texte trop rapide

Un débit de parole très rapide surcharge l'algorithme de lip-sync qui n'arrive pas à suivre.

Solution : Générez votre voix off avec un débit plus lent. Ajoutez des pauses. Les outils TTS permettent souvent de contrôler la vitesse.

Techniques de correction post-production

Technique 1 : Ajustement temporel manuel

Si le lip-sync est globalement bon mais décalé :

- Importez audio et vidéo dans votre logiciel de montage

- Séparez les pistes si elles sont liées

- Décalez l'audio de quelques frames (positif ou négatif)

- Testez jusqu'à alignement optimal

Astuce : Cherchez un son "explosif" (P, B, T) et alignez visuellement la fermeture des lèvres avec ce son.

Technique 2 : Recouper les mauvais passages

Si certains mots sont mal synchronisés :

- Identifiez les passages problématiques

- Coupez à ces endroits

- Insérez un plan de coupe (B-roll) qui cache le visage

- Reprenez sur un passage où le lip-sync est correct

Cette technique est utilisée même dans le doublage professionnel.

Technique 3 : Utiliser des outils de re-synchronisation

Des outils comme Wav2Lip permettent de régénérer le lip-sync à partir d'une vidéo existante et d'un nouvel audio.

- Exportez votre vidéo avec le mauvais lip-sync

- Exportez votre audio propre

- Passez les deux dans Wav2Lip

- Le tool régénère les mouvements de bouche

Limitation : Qualité variable, peut introduire des artefacts.

Technique 4 : Masquer le problème créativement

Parfois, la meilleure solution est de ne pas montrer les lèvres :

- Plan de dos : Le personnage parle mais on ne voit pas sa bouche

- Voix off pure : Le personnage pense, pas besoin de bouger les lèvres

- Téléphone/radio : La voix vient d'un appareil, pas du personnage visible

- Mask/obstacle : Un objet cache partiellement le visage

Workflow optimisé pour du bon lip-sync

Étape 1 : Préparez un audio parfait

- Utilisez un TTS de qualité (ElevenLabs)

- Débit modéré (pas trop rapide)

- Pauses naturelles entre les phrases

- Export en haute qualité (WAV ou MP3 320kbps)

Étape 2 : Choisissez le bon outil

- Pour du corporate sérieux : Synthesia ou HeyGen premium

- Pour des personnages stylisés : D-ID

- Pour du custom complet : Wav2Lip + votre propre vidéo

Étape 3 : Testez avant de produire

Avant de générer 10 minutes de vidéo :

- Faites un test de 30 secondes

- Vérifiez le lip-sync sur des sons difficiles (P, B, M, F, V)

- Ajustez l'avatar ou l'audio si nécessaire

Étape 4 : Prévoyez le montage

- Ayez du B-roll prêt pour les plans de coupe

- Planifiez des moments où le visage n'est pas visible

- Gardez l'option de correction post-prod

Ce que les débutants font mal

Erreur 1 : Utiliser n'importe quel audio

Vous prenez un enregistrement de mauvaise qualité avec du bruit de fond. Le lip-sync est catastrophique.

La correction : Investissez dans un audio propre. Un bon TTS ou un bon micro.

Erreur 2 : Choisir l'avatar au hasard

Vous prenez le premier avatar sans tester le lip-sync.

La correction : Testez 3-4 avatars avec le même texte. Choisissez celui avec le meilleur résultat.

Erreur 3 : Ignorer la langue

Vous utilisez un outil optimisé pour l'anglais avec du français et vous êtes surpris que ça marche mal.

La correction : Vérifiez le support linguistique. Certains outils ont des modes français dédiés.

Erreur 4 : Tout montrer en gros plan

Toute la vidéo est un gros plan sur le visage, rendant chaque défaut de lip-sync visible.

La correction : Variez les plans. Plans moyens, plans de coupe, illustrations. Ça réduit la pression sur le lip-sync.

L'avenir du lip-sync IA

La technologie progresse rapidement. Les dernières versions de Sora et des modèles vidéo avancés intègrent de mieux en mieux la synchronisation labiale.

Évolutions attendues :

- Lip-sync temps réel pour le streaming

- Meilleur support multilingue

- Gestion des émotions (sourire en parlant, etc.)

- Synchronisation avec des personnages stylisés (animation)

En attendant, combinez les bons outils avec des techniques de montage intelligentes.

Foire aux questions

Le lip-sync sera-t-il un jour parfait ?

Les meilleurs systèmes actuels s'approchent de la perfection pour l'anglais. Le français et d'autres langues rattrappent leur retard. Dans 2-3 ans, les défauts majeurs devraient être résolus pour la plupart des cas.

Wav2Lip est-il gratuit ?

Oui, c'est un projet open source. Vous pouvez l'utiliser gratuitement localement. Certains services en ligne l'intègrent avec une interface plus simple (parfois payants).

Puis-je corriger le lip-sync d'une vraie vidéo ?

Oui. Wav2Lip et outils similaires peuvent prendre une vraie vidéo et régénérer le lip-sync. C'est utile pour le doublage ou pour corriger des problèmes techniques.

Le lip-sync est-il meilleur en avatar 3D ou en photo animée ?

Les avatars 3D de haute qualité (Synthesia, HeyGen premium) ont généralement un meilleur lip-sync car les animations sont plus contrôlées. Les photos animées (D-ID) sont plus impressionnantes visuellement mais le lip-sync peut être moins précis.

Comment juger si un lip-sync est "assez bon" ?

Montrez la vidéo à quelqu'un qui ne connaît pas le projet. S'il remarque le décalage spontanément, c'est problématique. S'il faut le lui faire remarquer, c'est probablement acceptable.

Les filtres de "talking head" sur TikTok utilisent-ils la même technologie ?

Oui, les principes sont similaires. Les filtres grand public sont optimisés pour la rapidité plus que la qualité, mais la technologie de base est apparentée.

Votre avis

Chargement…

Sur le même thème sur ce site

Ces guides prolongent l’article sans répéter le même angle. Ils renforcent le maillage interne et aident à explorer le sujet en profondeur.

Voir tous les articles « Vidéo IA »

- Meilleures IA pour créer des vidéos

- Tutoriels vidé IA avancés

- Workflow débutant, de l’idée à la vidéo

- Panorama des outils IA

Articles proches sur le blog

Suggestions basées sur la catégorie, les mots du titre et le sujet, pour prolonger la lecture sans dupliquer les piliers ci-dessus.

- Traduire une vidéo en anglais en gardant la même voix (Lip Sync IA)

- Faire chanter une image fixe : les outils de synchronisation labiale (Lip-sync)

- Ajouter des émotions (rire, pleurs, chuchotements) à une voix off IA

- Synchronisation Labiale (Lip Sync) et IA Vidéo , Les Limites et Solutions Actuelles

Sources et cadre officiel (lectures externes)

Renseignements généraux, droit et bonnes pratiques publiés par des institutions. À consulter selon votre situation et votre juridiction.

Frank Houbre - expert IA vidéo et Image

Frank Houbre est un expert en IA vidéo et image, artiste IA et filmmaker récompensé aux Seoul International AI Film Festival et aux Mondial Chroma Awards. Avec plus de 10 ans d'expérience en entrepreneuriat digital, il crée des courts-métrages et animés entièrement générés par IA (Midjourney, Kling, Adobe Firefly). Co-Fondateur de Screenweaver et de la communauté #AIStudios, il partage des tutoriels gratuits et avis d'outils sur Business Dynamite pour aider les créateurs à automatiser leur production.

Continuer la lecture

Traduire une vidéo en anglais en gardant la même voix (Lip Sync IA)

Doublage et lip-sync IA : traduire une vidéo dans une autre langue en gardant la voix et la synchronisation labiale. Outils et workflow.

Faire chanter une image fixe : les outils de synchronisation labiale (Lip-sync)

Apprenez à faire chanter ou parler une image fixe avec les outils de lip-sync IA. Workflows pratiques, erreurs à éviter et intégration dans vos projets vidéo.

Ajouter des émotions (rire, pleurs, chuchotements) à une voix off IA

Rendre une voix synthétique plus vivante : rire, tristesse, chuchotement, colère avec ElevenLabs, réglages et bonnes pratiques.

Synchronisation Labiale (Lip Sync) et IA Vidéo , Les Limites et Solutions Actuelles

Lip sync en IA vidéo en 2026 : limites des générateurs (Runway, Kling), désynchronisation des lèvres, et solutions (logiciels tiers, avatars HeyGen/Synthesia).

Montage Vidéo IA sur CapCut , Intégrer Voix Off Google, Bruitages et Keyframes

Montage vidéo IA sur CapCut : intégrer voix off (Google Studio), bruitages, keyframes pour zooms et transitions. Workflow post-production accessible.

Remplacer une Agence Créative par l'IA , Outils, Scripts, Voix Off et Montage

Automatiser la production créative avec l'IA : scripts, visuels, voix off et montage. Workflow de A à Z pour remplacer ou compléter une agence créative.