Mercredi 1er octobre 2025 restera comme une date charnière. Oui, on parle bien de “dinguerie” et de “disruption” — et pour une fois, ces mots ne sont pas galvaudés. Vous l’avez sans doute vu passer : Sora 2, le nouveau modèle vidéo d’OpenAI, a été dévoilé. Et au-delà du wow effect, c’est une bascule. Pas seulement pour la création de contenus, mais pour la compréhension du monde physique par l’IA, pour nos métiers, pour les réseaux sociaux, et même pour la géostratégie. Rien que ça.

Vous avez manqué la conf’ ? Pas grave. Prenez un café. On fait le tour, calmement, avec des exemples concrets, des usages réels et les implications qui piquent un peu, parfois.

Sora 2 : de la démonstration au séisme

Vous avez peut-être vu cet écran d’introduction : “Everything you are about to see was generated by Sora 2.” Simple. Clair. Et pourtant, beaucoup n’ont pas mesuré l’onde de choc.

Sora 2 ne génère pas “juste” des vidéos. Il compose des scènes cohérentes où la brume se comporte comme de la brume, la glace éclate comme de la glace, des cheveux volent au vent comme… des cheveux au vent. Autrement dit : une compréhension fine des lois du monde physique transparaît dans le rendu. Illusion statistique ? Modélisation avancée ? Peu importe la case : à l’écran, ça tient debout.

Pourquoi c’est si incroyable ?

- Réalisme bluffant : matériaux, fluides, lumière, ombres, reflets… tout semble “tomber juste”.

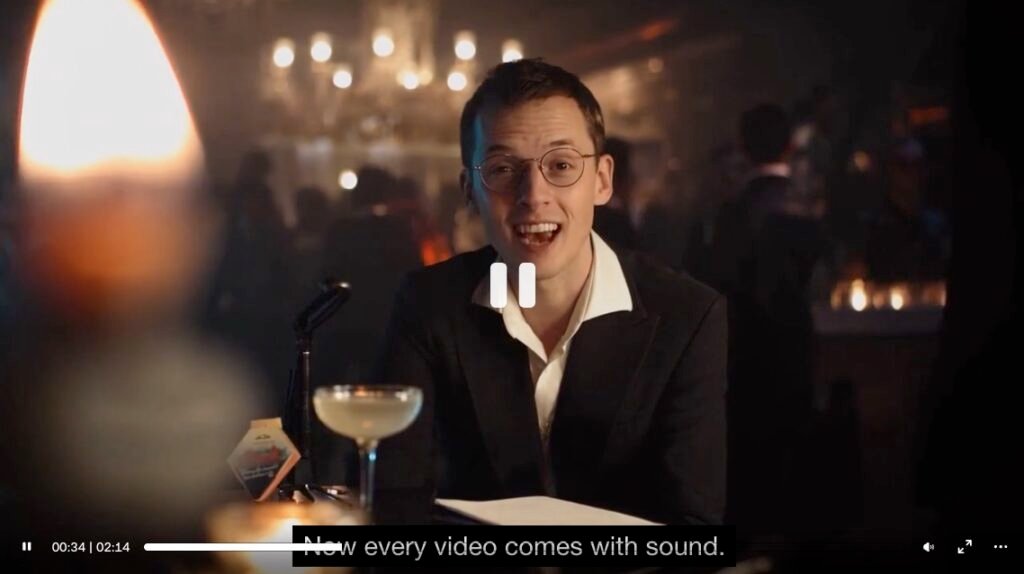

- Multi-pistes : image + musique + bruitages + voix. La scène vit, respire, “sonne vrai”.

- Cohérence spatiale : la caméra bouge, l’échelle tient, les interactions aussi.

- Stylisation maîtrisée : réaliste, animé, vintage, 80’s… la pâte visuelle reste crédible.

Vous vous dites encore “on reconnaît quand même que c’est de l’IA” ? Très bien. Mais souvenez-vous de votre réaction aux versions précédentes. À chaque palier, le doute se rétrécit. Et il y aura un Sora 3, un Sora 4…

Caméo : quand votre visage entre dans la scène

La fonctionnalité Cameo est le second crochet du gauche. Elle permet d’apprendre un visage (le vôtre, celui d’un collègue, d’un acteur) et de l’intégrer dans une scène générée, avec synchronisation labiale et cohérence de mouvement.

Concrètement ? Vous pouvez vous “filmer” dans un décor qui n’existe pas, avec des actions qui n’ont jamais eu lieu. De quoi relancer sérieusement le débat sur les deepfakes — et, en miroir, ouvrir des possibilités artistiques vertigineuses.

Opportunités réelles

- Cinéma et publicité : tests de scènes, storyboards animés, itérations rapides sans plateau ni équipe XXL.

- Éducation et formation : simulations immersives avec des “acteurs” disponibles 24/7.

- Création indépendante : clips, courts métrages, formats narratifs inédits, sans caméras ni studios.

Oui, il y a des risques. Mais il y a surtout un nouveau langage qui s’ouvre. À manier avec éthique, évidemment.

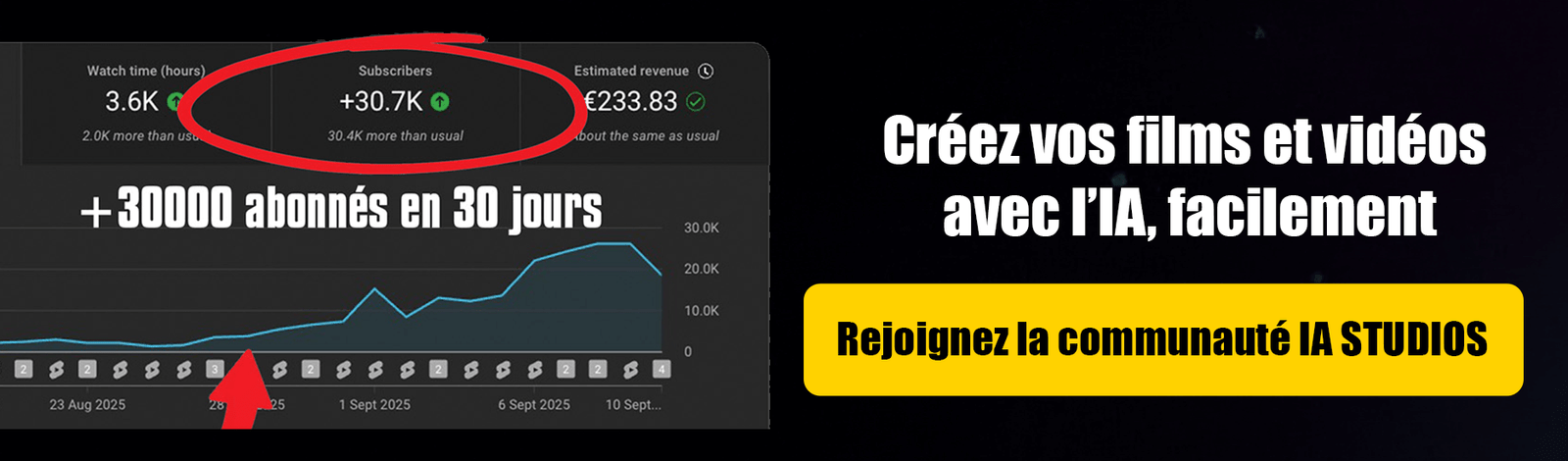

Sora App : un nouveau réseau social… 100 % IA

OpenAI ne s’arrête pas au modèle. Une application Sora débarque (d’abord sur iOS et d’abord aux États-Unis et au Canada). L’idée ? Un réseau social peuplé exclusivement de contenus générés par IA.

On crée, on remixe, on s’invite en Caméo, on joue avec les styles… et surtout, tout est balisé comme généré. C’est un pari : embrasser le deepfake en le rendant explicite, plutôt que de le voir se faufiler partout ailleurs sans garde-fous.

Ce que cela change pour vous

- Production ultra-rapide : vous avez une idée le matin, vous publiez une scène le midi.

- Remix par la communauté : vos vidéos deviennent des tremplins créatifs.

- Identité maîtrisée : vous pouvez autoriser (ou non) l’utilisation de votre visage.

Question qui fâche : ces contenus générés resteront-ils cantonnés à Sora, ou vont-ils déferler sur TikTok, YouTube, Instagram ? La réponse : vous la connaissez déjà. La frontière entre création et diffusion est poreuse. Préparez-vous.

Obtenir un code d’invitation Sora 2 : modes d’accès et bonnes pratiques

Vous me l’avez beaucoup demandé : comment récupérer un code d’invitation pour tester Sora 2 (et, le cas échéant, l’app Sora) sans perdre des heures ni se faire piéger ? Voici une méthode claire, 100 % clean et orientée résultats.

Les voies d’accès légitimes (prioritaires)

- Liste d’attente officielle

Inscrivez-vous avec votre compte OpenAI (même e-mail, même identité). Soignez votre mini-profil : secteur, cas d’usage, volume de tests envisagé. Les équipes priorisent les profils “créateurs/prod” et les marques avec projets concrets. - Programmes partenaires

Les studios, agences, plateformes e-commerce et écoles médias partenaires obtiennent parfois des batchs d’invitations. Si vous dépendez d’un tel organisme, passez par votre contact interne (direction de prod, innovation, relations écoles). - Événements & challenges

Démos privées, hackathons, programmes “early creators” : gardez un œil sur les annonces officielles et les communautés pro (motion design, VFX, créa social). Les organisateurs reçoivent souvent quelques codes à distribuer aux projets sérieux. - Créateurs référents

Certains créateurs pilotes obtiennent des invites limitées pour leur communauté. Si un code est partagé, vérifiez qu’il renvoie vers un domaine officiel (jamais un site louche, jamais une page de paiement tiers).

Ce qui augmente vos chances

- Un projet précis, pas une curiosité vague

Décrivez un use case solide : “série de mini-films produits chaque semaine”, “catalogue e-commerce animé”, “cours en ligne avec scènes pédagogiques”. - Capacité de publication

Montrez que vous publiez régulièrement (YouTube, TikTok, Insta, site), que vous saurez documenter et partager vos résultats (c’est précieux pour l’écosystème). - Cadre éthique & légal

Mentionnez vos règles internes : consentement Caméo, droit à l’image, mention du caractère génératif. Oui, ça compte.

Procédure type (pas à pas)

- Créez/validez votre compte OpenAI avec une identité unique et sécurisée (2FA activée).

- Inscrivez-vous à la waitlist et renseignez un mini-dossier (pitch de 5 lignes, plan de diffusion, échéance).

- Préparez votre environnement : équipe, pipeline (stockage, versioning, archives), check-list légale (droits, mentions, politique Caméo).

- Surveillez l’e-mail d’invitation (et vos spams) : les codes ont parfois une durée de validité courte.

- Activez rapidement et générez un premier proof-of-concept (30–60 s), puis documentez (équipe, prompts, rendu, limites).

- Remontez un feedback utile (qualité, bugs, usages réels). Les retours pertinents facilitent l’accès continu.

Ce qu’il faut éviter absolument

- Reventes de codes / “accès garantis” sur des places de marché ou DMs obscurs.

👉 99 % de scams. Aucun paiement externe ne doit être requis pour un accès. - Liens raccourcis non vérifiables (type domaines exotiques, faux formulaires “OpenAI”).

👉 Vérifiez le domaine et le certificat avant toute saisie. - Contourner les restrictions géographiques en violant les conditions d’utilisation.

👉 Outre l’éthique, vous risquez la révocation de l’accès et la perte de vos travaux.

Si vous n’avez pas (encore) de code

- Pré-produisez vos assets : bibliothèques de styles visuels, références sonores, chartes Caméo, prompts structurés. Le jour J, vous gagnerez des semaines.

- Simulez vos workflows avec d’autres moteurs (pour le cadrage, l’éditorial, la narration). L’apprentissage process vaut autant que l’outil.

- Montez un mini-portfolio “IA-ready” : trois cas d’usage, objectifs mesurables, plan de diffusion. C’est le meilleur passeport pour une invite.

Signaux d’arnaque (check-list rapide)

- Paiement demandé avant d’activer un code.

- Demande de mot de passe OpenAI ou d’informations bancaires hors site officiel.

- Promesse d’“illimité garanti” contre crypto ou gift-cards.

- Pression temporelle artificielle (“dans 10 min c’est fini”) + lien non officiel.

En bref : restez officiel, traçable, professionnel. Un projet clair, un cadre éthique assumé et un feedback utile valent mille “DM pour invite”. Et quand l’accès tombe, soyez prêt : un POC, des métriques, un plan de publication. C’est comme cela que l’on transforme un code d’invitation en avantage durable.

Le fond du sujet : vers une “compréhension” du monde par l’IA

On ne va pas faire de philosophie à rallonge, mais il faut le nommer : Sora 2 exhibe une modélisation comportementale du réel. Sans caméras, sans tournage, la scène “se tient”. Quand la lumière perce une brume froide au-dessus d’une glace qui craque, notre cerveau dit “oui”.

Est-ce que la machine “comprend” ? Disons plutôt : elle reproduit, avec précision, les régularités du monde. Pour vous, cela signifie moins de limitations. Vous décrivez une intention, Sora infère un ensemble de contraintes physiques implicites. Résultat : vous passez du texte à l’expérience visuelle.

Production vidéo : qui va encore dépenser des millions pour une “course de canards géants” ?

La phrase fait sourire, mais la question est sérieuse : quels budgets resteront rationnels face à des contenus quasi photo-réalistes générés en quelques itérations ?

Pas tout, pas tout de suite. Les tournages “prestige” gardent une aura, des besoins, des obligations. Mais pour :

- des concepts viraux,

- des spots test,

- des décors inaccessibles,

- des créatures impossibles,

… Sora 2 change le calcul. L’expérimentation devient peu coûteuse et infiniment itérable. Les barrières à l’entrée tombent. Nous allons tous, peu ou prou, devenir réalisateurs.

E-commerce : l’“instant checkout” et l’Agentic Commerce Protocol

Pendant que vous digérez Sora, OpenAI pousse un autre pion : l’achat en un clic depuis l’IA.

Le principe : vous discutez d’un produit dans ChatGPT, l’IA trouve l’article, et vous payez sans quitter la conversation. Techniquement, cela repose sur un “Agentic Commerce Protocol” co-conçu avec les acteurs du paiement. Résultat : moins de frictions, plus de conversions, un web qui s’efface derrière les agents.

Pour vous, côté boutique

- À prévoir : exposer clairement variantes, options, stock, règles de panier… pour que l’agent s’en sorte sans ambiguïté.

- À gagner : un canal de vente natif dans les assistants — avec un tunnel d’achat instantané.

- À accepter : moins de “trafic” classique, plus de transactions portées par des agents.

Oui, c’est un changement de paradigme. Mais c’est aussi une opportunité d’être présent là où l’attention se déplace : dans les interfaces conversationnelles.

Et pendant ce temps, chez les concurrents : Claude “Sonnet” 4.5 sort les muscles

Anthropic avance aussi. Claude Sonnet 4.5 pousse très fort sur le code, les tâches techniques et mathématiques, avec des capacités d’autonomie prolongée. Vous êtes développeur·se ? Posez-vous une question simple : pouvez-vous travailler 20 heures d’affilée avec la même rigueur ? La machine, elle, oui — sur des tâches ciblées.

Sans tomber dans la bataille de chiffonniers des benchmarks, retenez surtout la spécialisation :

- Pour la vidéo et le grand public : Sora 2 et l’écosystème OpenAI prennent une longueur d’avance.

- Pour le code intensif, l’ingénierie, la CLI, l’intégration profonde aux workflows dev : Claude Sonnet 4.5 marque des points sérieux.

Autrement dit : on entre dans l’ère des modèles “métiers”. Selon votre usage, l’outil optimal ne sera pas le même. Et c’est très bien.

Sora 2 : que faire, ici et maintenant ?

Très bien, vous avez compris l’ampleur. Qu’est-ce qu’on fait concrètement dès cette semaine ?

Si vous êtes créateur·trice ou marque

- Prototypage : transformez vos idées en previews vidéo. Testez des décors, des ambiances, des gimmicks visuels.

- Bibliothèque de styles : bâtissez des looks “maison” (réaliste, animé, rétro, documentaire) pour maintenir une identité reconnaissable.

- Cameo responsable : définissez qui peut utiliser quel visage, dans quelles limites. Écrivez vos règles — et tenez-vous-y.

- Pilotage ROI : comparez un shoot réel vs génératif pour des contenus A/B. Vous serez surpris des écarts de délai et de budget.

Si vous êtes e-commerçant

- Préparez le terrain agentique : clarifiez vos données produits (variantes, tailles, stocks) pour l’Agentic Commerce Protocol.

- Refondez le “tunnel” : ne pensez plus “trafic → pages → panier → paiement”, pensez “intention → réponse → achat instantané”.

- Créez des assets génératifs : fiches produit animées, démos en situation, “essais” virtuels. L’IA peut montrer ce que la photo ne peut pas.

Si vous êtes dev / équipe produit

- Évaluez la stack : testez Claude Sonnet 4.5 pour les tâches longues et complexes ; outil spécialisé pour chaque besoin.

- Automatisez les tâches ingrates : documentation, tests, migration de bouts de code. Laissez les modèles mâcher la paille.

- Gardez la main : l’humain décide, l’IA exécute. Les meilleures équipes seront celles qui orchestrent bien.

Objections fréquentes… et réponses honnêtes

“On voit encore que c’est de l’IA.”

Peut-être, aujourd’hui, sur certains plans. Mais la marge rétrécit à vue d’œil. Ne fondez pas votre stratégie sur un délai d’obsolescence… qui se compte en mois.

“Les studios vont disparaître.”

Non. Ils vont se transformer. Les métiers créatifs se déplacent vers la direction artistique, la supervision, le pipeline. Moins de logistique, plus d’itération.

“On va être noyés sous les deepfakes.”

Justement, Sora App affiche la couleur : 100 % IA, tagué comme tel. Ailleurs, la traçabilité deviendra un enjeu régulatoire et technique majeur. Il faut participer au débat — et poser des garde-fous dans vos propres pratiques.

Check-list pratique pour démarrer (et ne pas se perdre)

- Définissez 3 cas d’usage prioritaires (promo produit, storytelling, formation…).

- Rédigez des prompts clairs (intention, ambiance, mouvement de caméra, sons).

- Créez un cahier de styles (réaliste / animé / vintage / docu).

- Établissez des règles éthiques (Cameo, droits à l’image, diffusion).

- Mesurez coûts, délais, engagement sur 3 contenus pilotes.

- Décidez où l’IA remplace et où elle augmente vos workflows.

- Préparez l’agentic commerce si vous vendez en ligne (données propres, variations explicites).

Conclusion : une nouvelle grammaire visuelle et économique

Sora 2 n’est pas un gadget de plus. C’est une nouvelle grammaire. On passe du tournage au design d’expériences vidéo. Les agents s’invitent dans l’achat. Les modèles se spécialisent par métier. La géopolitique s’ajuste.

La meilleure posture ? Curiosité active et cadre clair. Testez, mesurez, apprenez vite. Et gardez le cap : ce n’est pas une mode, c’est un déplacement durable de la création et de la distribution.

Envie d’aller plus loin ? Choisissez un projet modeste et réalisez-le intégralement en génératif. Vous aurez, dès la semaine prochaine, des enseignements concrets à partager — et une longueur d’avance.

FAQ

Sora 2 est-il disponible partout ?

La disponibilité initiale est limitée (pays et plateformes), avec une montée en puissance progressive. Rien ne vous empêche de préparer vos workflows et vos bibliothèques de styles dès maintenant.

Qu’est-ce que Caméo, exactement ?

C’est la capacité d’apprendre un visage et de l’intégrer de façon réaliste dans une scène générée, avec synchronisation labiale et cohérence lumière/mouvement. À utiliser avec consentement et politiques internes claires.

Peut-on utiliser Sora 2 pour des looks non réalistes (animé, rétro, etc.) ?

Oui. C’est même l’un des points forts : le réalisme quand on en a besoin, la stylisation quand on le souhaite — avec une cohérence de caméra et de mouvement qui fait la différence.

Et les voix, la musique, les bruitages ?

Sora 2 mixera image, sound design et voix. Ce n’est pas parfait partout, mais le cap est pris : produire des séquences multicanales crédibles sans passer par un studio complet.

Quel impact sur les métiers créatifs ?

Moins de temps en captation, plus en direction artistique, écriture, montage, calibrage de style. Les expertises humaines restent cruciales — elles se déplacent plus en amont et plus en orchestration.

Instant checkout : concrètement, comment s’y préparer côté boutique ?

Soignez vos données produits (variantes, contraintes, stocks), exposez-les proprement pour qu’un agent puisse décider sans ambiguïté. Réfléchissez par scénarios d’intention plutôt que par pages.

Claude Sonnet 4.5, je m’y intéresse si je ne code pas ?

Si votre cœur de métier n’est pas le code, l’intérêt direct est moindre. En revanche, pour les équipes tech, c’est un allié de poids pour des tâches longues et structurées. L’important : choisir le bon modèle pour le bon usage.

Quid des risques de deepfakes malveillants ?

Ils existent. La réponse est multi-couches : traçabilité, politiques éthiques, modération stricte là où c’est possible, et éducation des audiences. Sora App prend le parti de l’étiquetage explicite.

Des contenus 100 % IA vont-ils envahir les autres plateformes ?

Soyons lucides : oui. À vous de baliser : mention, style identifiable, narration transparente. Le public récompense la créativité — et la sincérité.

Votre prochain pas : choisissez une idée simple, écrivez un prompt précis, définissez un style, générez, itérez, publiez. Puis recommencez. Ceux qui apprennent vite maintenant écriront les codes de demain.