Analyser les émotions faciales de son audience avec l'IA pour adapter son montage

Utiliser l'analyse des expressions faciales (IA) sur des tests audience pour repérer les moments d'engagement ou de décrochage et affiner le montage en conséquence.

Tu as monté une vidéo. Tu aimerais savoir à quels moments les gens sourient, froncent les sourcils, détournent le regard ou s'ennuient. L'analyse des émotions faciales par IA (face tracking, expression recognition) permet, dans un cadre de test audience, de capter les réactions du visage et de les relier aux timecodes de ta vidéo. Tu obtiens des signaux : « À 1 min 23, 70 % des viewers ont montré une expression de surprise. À 2 min 10, une baisse d'attention. » Tu peux alors renforcer les plans qui accrochent et retravailler ceux qui font décrocher. L'outil ne remplace pas le ressenti humain ni le debrief, mais il donne des données objectives pour affiner ton montage. Voici comment analyser les émotions faciales de ton audience avec l'IA pour adapter ton montage, et ce que les débutants se trompent.

Pourquoi analyser les émotions faciales en post-production

En cinéma et en pub, les tests audience traditionnels reposent sur des questionnaires (« As-tu aimé ? », « Où as-tu décroché ? ») et parfois sur des entretiens. Les gens ne se souviennent pas toujours précisément des moments clés, ou ils rationalisent. L'analyse des expressions faciales (sourire, surprise, concentration, ennui, confusion) en temps réel pendant le visionnage donne des données continues : à chaque seconde, tu as un signal par viewer. En agrégeant plusieurs viewers, tu vois les pics d'engagement (sourires, attention) et les creux (détournement du regard, expressions neutres ou négatives). Tu peux croiser avec les timecodes de ton montage et décider : ce plan garde, ce plan raccourcit, cette transition ne fonctionne pas. Pour le fond (message, clarté), la simulation d'audience par IA sur le script et le storytelling et l'engagement émotionnel complètent ; l'analyse faciale apporte une couche comportementale au moment du visionnage. Pour le montage lui-même, l'agent de critique de montage et le rythme et la tension narrative aident à interpréter ces signaux et à retravailler la structure.

Ce que l'IA peut détecter (et les limites)

Utile : Sourire, surprise, concentration (regard fixe, sourcils), confusion (sourcils froncés), ennui ou désengagement (détournement du regard, expressions neutres), valence émotionnelle (positif / négatif / neutre). Les outils (APIs ou logiciels dédiés) renvoient souvent des scores par frame ou par segment. Limites : La précision dépend de la qualité de la capture (éclairage, angle de la caméra, nombre de viewers). Les cultures et les individus expriment différemment. L'IA peut confondre certaines expressions. Utilise les données comme indicateurs, pas comme vérité absolue. Croise avec des retours verbaux (questionnaire, debrief) pour interpréter. Pour l'impact émotionnel voulu en amont (couleurs, rythme), la psychologie des couleurs et l'IA et le storytelling assisté IA donnent des leviers créatifs ; l'analyse faciale mesure ensuite si ces leviers ont fonctionné.

Scénario 1 : Test audience en conditions contrôlées

Marie a un spot de 30 secondes. Elle organise une session de test : 5 à 10 personnes regardent la vidéo pendant qu'une caméra (webcam ou caméra dédiée) filme leur visage. Un logiciel ou une API d'analyse des expressions traite la vidéo des viewers et renvoie des courbes d'émotion par timecode.

Étape 1 : Capturer. Les viewers regardent la vidéo en plein écran. Une caméra enregistre leur visage (consentement obtenu, cadre fixe). La vidéo de test (le spot) a un timecode synchrone ou un marqueur de début pour aligner les réactions avec le montage.

Étape 2 : Analyser. Elle envoie les enregistrements des viewers à un outil d'analyse (ex. Affectiva, Azure Face API, ou logiciel dédié au test média). L'outil renvoie, par viewer et par seconde (ou par segment), des scores (joie, surprise, attention, etc.). Elle agrège les données (moyenne par timecode sur tous les viewers).

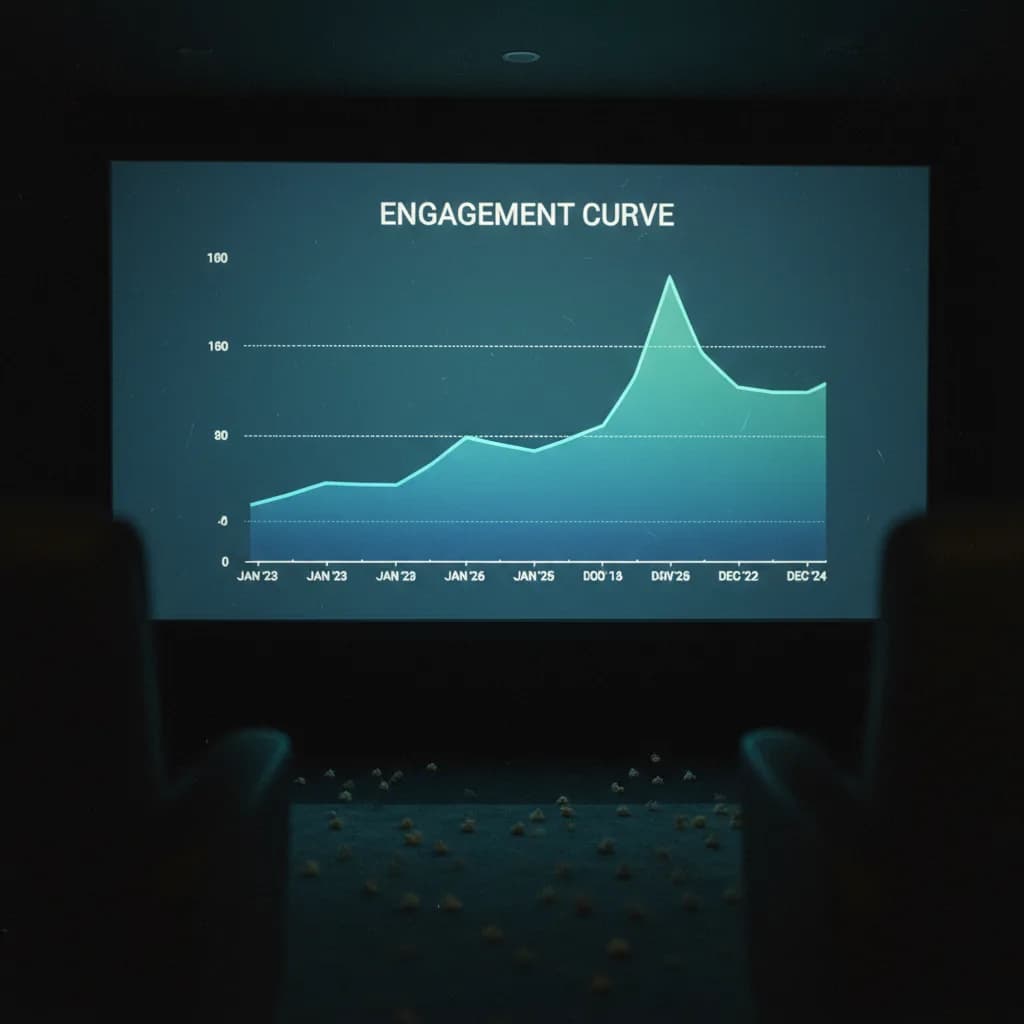

Étape 3 : Croiser avec le montage. Elle superpose la courbe d'engagement sur sa timeline (ou sur un export avec timecodes). Elle repère : les pics (plans qui accrochent), les creux (moments de décrochage). Elle décide de raccourcir un plan, d'ajouter un cut, ou de renforcer un moment fort. Pour structurer le montage en amont, le rythme et la tension narrative et les transitions invisibles aident ; l'analyse faciale valide ou infirme les choix après coup.

Scénario 2 : Utiliser des données existantes (webcam, en ligne)

Thomas ne peut pas organiser une session physique. Il utilise un outil de test en ligne : les viewers ouvrent un lien, regardent la vidéo avec leur webcam activée, et l'outil enregistre leur visage et analyse les expressions. Il récupère un rapport par viewer et un agrégat.

Workflow. Il choisit une plateforme de test audience avec analyse faciale (il en existe plusieurs, souvent payantes). Il upload sa vidéo, envoie le lien à un panel de testeurs. Les testeurs regardent une fois, la webcam enregistre. La plateforme renvoie des graphiques (engagement par timecode, émotions dominantes). Thomas exporte les timecodes des creux et des pics et les compare à son montage. Pour recruter des testeurs et définir les profils, la simulation d'audience par personae aide à cibler ; l'analyse faciale ajoute la dimension comportementale.

Scénario 3 : Itérer sur une version de montage

Léa a une V1 de son montage. Elle fait un premier test avec analyse faciale, repère 2 moments de décrochage (vers 1 min 10 et 2 min 30). Elle raccourcit ces plans, ajoute un cut, et refait un test avec la V2. Elle compare les courbes V1 vs V2 pour voir si les creux ont disparu ou diminué.

Métrique simple. Elle ne cherche pas la perfection. Elle vise : « Pas de creux en dessous de X % d'attention sur plus de 10 secondes. » Si la V2 respecte mieux ce critère, elle valide. Pour le reste du flux (génération des plans, voix, sound design), le montage vidéo automatique et le sound design restent les bases ; l'analyse faciale est une boucle de feedback en aval.

Workflow pas à pas : de la capture à l'ajustement du montage

1. Définir l'objectif du test

Qu'est-ce que tu veux mesurer ? L'engagement global, les moments de rire, les moments de confusion, les points de décrochage ? Ça détermine quelles métriques regarder (attention, joie, surprise, etc.) et comment interpréter les courbes.

2. Capturer les réactions

En présentiel : caméra fixe sur les viewers, consentement, timecode de la vidéo de test synchronisé. En ligne : plateforme de test avec webcam, même principe. Plus le cadre et l'éclairage sont stables, plus l'analyse est fiable.

3. Lancer l'analyse IA

Utilise une API (Azure Face, AWS Rekognition, ou outil dédié média) ou un logiciel qui prend en entrée les vidéos des viewers et la vidéo de test. Récupère les sorties par timecode (scores d'émotion, attention).

4. Agréger et visualiser

Moyenne (ou médiane) des scores par timecode sur tous les viewers. Superpose sur la timeline de ton montage. Repère les pics et les creux. Note les timecodes des plans concernés.

5. Ajuster le montage

Raccourcir les plans dans les creux, renforcer les plans dans les pics (durée, cut, ou ajout d'un élément). Refais un test si tu veux valider la V2. Pour des pistes concrètes de coupe et de rythme, l'agent de critique de montage et le structurer le rythme donnent des cadres.

Ce que les débutants se trompent (tranchée)

Erreur 1 : Croire que l'IA lit « l'émotion » parfaite

Les modèles détectent des expressions faciales (muscles, sourcils, bouche). Ils n'accèdent pas à l'intention ni au contexte. Une expression « surprise » peut être positive ou négative. Interprète avec prudence et croise avec des retours verbaux.

Erreur 2 : Trop peu de viewers

Avec 1 ou 2 personnes, les courbes sont bruitées. 5 à 10 viewers minimum pour avoir des tendances utilisables. Plus tu en as, plus l'agrégat est stable.

Erreur 3 : Mauvaise qualité de capture

Webcam mal placée, lumière changeante, viewers qui bougent : la détection faciale peut échouer ou être imprécise. Cadre fixe, visage bien visible, éclairage constant améliorent les résultats.

Erreur 4 : Ne pas synchroniser avec le timecode

Si tu ne sais pas à quelle seconde de ta vidéo correspond chaque réaction, les données sont inutilisables. Assure-toi que le logiciel d'analyse ou la plateforme aligne bien les réactions avec le timecode de la vidéo testée.

Erreur 5 : Tout couper selon les creux

Un creux peut venir du contenu (moment calme voulu) ou d'un vrai problème (ennui). À toi de distinguer : si le creux correspond à une transition ou à un plan que tu sentais déjà faible, c'est un signal pour modifier. Si c'est un moment de respiration nécessaire, ne pas sur-réagir.

| Problème | Piste de solution |

|---|---|

| Outil d'analyse cher ou complexe | Commencer avec une API (Azure Face, etc.) et un script simple qui agrège les scores par timecode |

| Viewers pas représentatifs | Recruter des profils proches de ta cible (âge, centre d'intérêt) ; documenter qui a testé |

| Courbes trop bruitées | Augmenter le nombre de viewers ; lisser les courbes (moyenne glissante sur 5–10 s) |

| Pas de debrief après le test | Combiner analyse faciale + 3–4 questions courtes (« Où as-tu décroché ? », « Quel moment t'a le plus marqué ? ») |

Pro Tip. Garde les courbes d'engagement par projet. Au fil du temps tu vois quels types de plans ou de rythmes génèrent des pics récurrents ; tu peux en tenir compte dès le montage suivant.

Outils et intégration

APIs d'analyse faciale : Azure Face API (détection d'émotions), AWS Rekognition, Google Cloud Vision (attributs du visage). Plateformes de test audience avec analyse faciale : selon l'offre du moment (recherche « facial expression analysis video test audience »). Montage : une fois les timecodes des creux et des pics identifiés, tu retravailles dans ton logiciel habituel (DaVinci, CapCut, etc.). Pour le reste du flux créatif, le montage vidéo automatique, le storytelling et l'engagement et la psychologie des couleurs posent les bases ; l'analyse faciale est une boucle de mesure en aval. La vidéo

ChatGPT - Le prompt ULTIME (il génère tout)

montre des outils d'édition assistée ; l'analyse des réactions audience vient après pour affiner le résultat.

Ressource externe : Azure Face API (analyse du visage).

Foire aux questions

L'analyse faciale est-elle conforme au RGPD ?

Oui si tu informes les participants, recueilles leur consentement explicite et traites les données selon une base légale (consentement, intérêt légitime). Les enregistrements de visage sont des données biométriques dans l'UE ; vérifie les obligations (information, droit d'accès, durée de conservation) et consulte un juriste si besoin.

Puis-je utiliser l'analyse faciale sur des vidéos déjà publiées (ex. YouTube) ?

Tu n'as pas accès aux visages des viewers sur YouTube. L'analyse faciale suppose une capture pendant le visionnage (test dédié). Les analytics YouTube (rétention, clics) donnent d'autres signaux (où les gens quittent la vidéo) sans analyse faciale ; voir la gestion des métadonnées et de la rétention et la stratégie contenu.

Combien de viewers pour un test fiable ?

5 à 10 minimum pour dégager des tendances. 15–20 ou plus pour des décisions plus solides. Au-delà, les gains de précision diminuent. Adapte selon ton budget et la criticité du projet.

L'IA peut-elle analyser les émotions sur des personnages dans la vidéo (pas les viewers) ?

Oui. Tu peux analyser les expressions des personnages à l'écran (pour vérifier la cohérence émotionnelle d'une scène, ou pour du contenu généré par IA). C'est un autre cas d'usage : l'entrée est ta vidéo (frames des personnages), la sortie est des scores d'émotion par timecode. Pas besoin de viewers pour ça.

Comment combiner avec l'agent de critique de montage ?

L'agent de critique de montage travaille sur la structure (feuille de montage, transcription) et donne des pistes (rythme, longueurs). L'analyse faciale donne des données sur les réactions réelles. Tu peux envoyer à l'agent : « Voici ma feuille de montage et les timecodes où l'engagement a chuté [liste]. Propose des modifications. » L'agent suggère des coupes ou des ajustements ; tu valides avec ton jugement et éventuellement un second test.

Prompt: Cinematic stills, cinema photography, medium shot of a creator reviewing notes and a timeline, soft daylight, 35mm lens, natural film grain, focused, --ar 16:9

Votre avis

Chargement…

Sur le même thème sur ce site

Ces guides prolongent l’article sans répéter le même angle. Ils renforcent le maillage interne et aident à explorer le sujet en profondeur.

Voir tous les articles « Vidéo IA »

- Meilleures IA pour créer des vidéos

- Tutoriels vidé IA avancés

- Workflow débutant, de l’idée à la vidéo

- Panorama des outils IA

Articles proches sur le blog

Suggestions basées sur la catégorie, les mots du titre et le sujet, pour prolonger la lecture sans dupliquer les piliers ci-dessus.

- Ajouter des émotions (rire, pleurs, chuchotements) à une voix off IA

- Utiliser l'IA pour le montage vidéo automatique (suppression des silences)

- Comment analyser les tendances virales YouTube avec l'IA pour valider des concepts

- Montage Vidéo IA sur CapCut , Intégrer Voix Off Google, Bruitages et Keyframes

Sources et cadre officiel (lectures externes)

Renseignements généraux, droit et bonnes pratiques publiés par des institutions. À consulter selon votre situation et votre juridiction.

Frank Houbre - expert IA vidéo et Image

Frank Houbre est un expert en IA vidéo et image, artiste IA et filmmaker récompensé aux Seoul International AI Film Festival et aux Mondial Chroma Awards. Avec plus de 10 ans d'expérience en entrepreneuriat digital, il crée des courts-métrages et animés entièrement générés par IA (Midjourney, Kling, Adobe Firefly). Co-Fondateur de Screenweaver et de la communauté #AIStudios, il partage des tutoriels gratuits et avis d'outils sur Business Dynamite pour aider les créateurs à automatiser leur production.

Continuer la lecture

Ajouter des émotions (rire, pleurs, chuchotements) à une voix off IA

Rendre une voix synthétique plus vivante : rire, tristesse, chuchotement, colère avec ElevenLabs, réglages et bonnes pratiques.

Utiliser l'IA pour le montage vidéo automatique (suppression des silences)

Automatiser la suppression des silences et des temps morts dans tes interviews, podcasts et tutoriels avec Descript, CapCut et outils dédiés. Workflow pas à pas.

Comment analyser les tendances virales YouTube avec l'IA pour valider des concepts

Utiliser l'IA pour repérer les tendances YouTube, tester des angles et valider des concepts avant de produire. Outils, méthodes et pièges à éviter.

Montage Vidéo IA sur CapCut , Intégrer Voix Off Google, Bruitages et Keyframes

Montage vidéo IA sur CapCut : intégrer voix off (Google Studio), bruitages, keyframes pour zooms et transitions. Workflow post-production accessible.

Remplacer une Agence Créative par l'IA , Outils, Scripts, Voix Off et Montage

Automatiser la production créative avec l'IA : scripts, visuels, voix off et montage. Workflow de A à Z pour remplacer ou compléter une agence créative.

Raccord et montage vidéo IA : comment lier des scènes générées séparément

Enchaîner proprement des plans générés par différents moteurs ou à différents moments : coupes, raccords visuels et sonores, cohérence couleur et rythme.