Comment Créer un Mini-Film de A à Z avec l'Intelligence Artificielle en 2026 ?

Workflow complet pour créer un mini-film avec l'IA en 2026 : préproduction (Notebook LM, storyboard), génération (Midjourney, Runway), montage (CapCut).

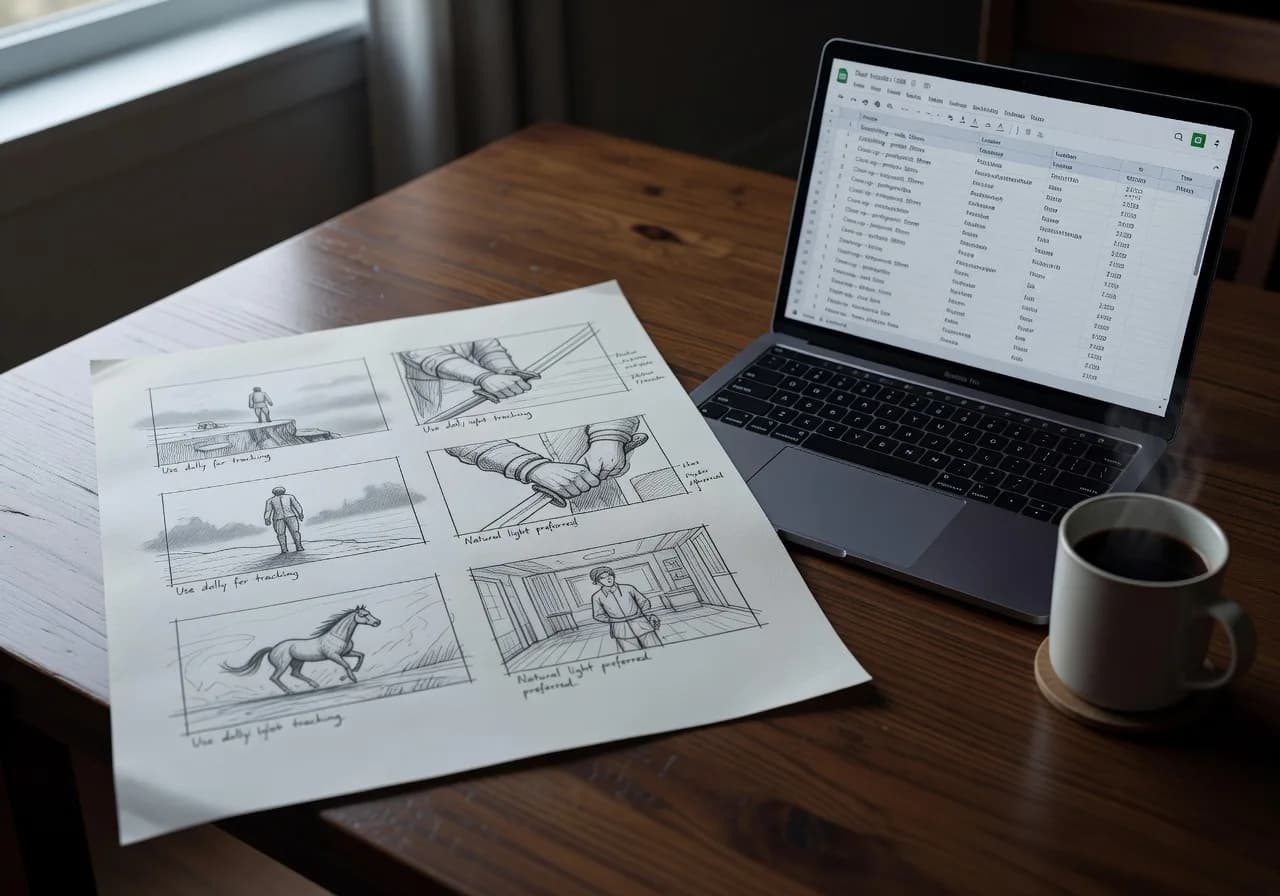

Tu veux réaliser un mini-film sans équipe ni tournage. Juste toi, un ordinateur et les bons outils. Créer un film avec l’IA en 2026, de A à Z, est à la portée d’un créateur indépendant : préproduction (histoire, storyboard), génération d’images et d’animations, post-production et montage. Ce tutoriel décrit un workflow concret avec des outils accessibles (Notebook LM, Midjourney, Runway, CapCut) pour produire un mini-film sans équipe ni matériel lourd. Tu y trouveras les étapes précises, des scénarios réels et ce que les débutants se trompent. Pour les détails par outil, voir cinématographie IA avec Cinema Studio, comparatif Runway Kling Pika et montage vidéo IA sur CapCut.

Vue d’ensemble du workflow

- Préproduction : Idée, structure narrative, storyboard (texte ou visuel). Tu définis les plans dont tu as besoin avant de générer quoi que ce soit.

- Production visuelle : Images clés (Midjourney ou équivalent), animation (Runway, Cinema Studio, Kling, etc.). Tu génères plan par plan en gardant une cohérence de style.

- Post-production : Upscaling si besoin (TensorPix), montage (CapCut), voix off et sound design. Tu assembles, tu ajoutes le son, tu finalises.

- Export : Rendu final aux bons formats (1080p, 4K, 16:9, 9:16 selon usage). Pour workflow préproduction et storyboards IA et importance du storyboard avant la création vidéo, la phase amont est détaillée. Here’s why that matters : sans storyboard, tu génères au hasard et tu perds du temps et des crédits. Avec un découpage clair, tu enchaînes les plans comme sur un vrai tournage.

Étape 1 : Préproduction et storyboard

Notebook LM (Google) permet d’analyser tes documents (synopsis, notes) et de structurer l’histoire. Tu peux lui demander un découpage en scènes ou en plans. À partir de là, listes les images clés dont tu as besoin : plan large, gros plan, plan d’ensemble, etc. Un storyboard même simple (texte + références visuelles) évite de générer au hasard. Workflow concret : rédige un synopsis en 5–10 lignes. Colle-le dans Notebook LM (ou ChatGPT). Demande : « Découpe cette histoire en 10–15 plans. Pour chaque plan, indique : numéro, type de plan (large, moyen, gros plan), description visuelle courte, durée estimée (secondes). » Tu obtiens une liste exploitable. Tu peux aussi dessiner à la main des croquis très basiques (cadrage, sujet) pour fixer les idées. Pour workflow préproduction et storyboards IA, les outils et la méthode sont détaillés. Pour importance du storyboard généré IA, les bénéfices (cohérence, gain de temps) sont expliqués.

Étape 2 : Génération d’images sources

Génère les images correspondant à chaque plan (Midjourney, Leonardo, DALL·E, etc.). Garde une cohérence : même style (cinématographique, photoréaliste, etc.), même ratio (16:9 recommandé pour le cinéma). Utilise des prompts détaillés : éclairage, cadrage, ambiance. Exemple : « Cinematic stills, wide shot, old bookstore interior, dust in the air, soft window light, 35mm lens, film grain, moody, photorealistic. » Pour des mouvements de caméra simulés en IA, la grammaire des plans (travelling, pan, tilt) influence le prompt. Pour Cinema Studio sur Xfield, les objectifs et mouvements pro (pan, travelling, start-and-frame) sont détaillés. Pour prompt parfait images photoréalistes, la structure sujet + éclairage + cadrage + contraintes s’applique à chaque image clé. But there’s a catch : génère plusieurs variantes par plan (2–4) et garde la meilleure. La première image n’est pas toujours la bonne. Pour seed et style reference Midjourney, tu peux figer une esthétique sur toute la série.

Étape 3 : Animation et génération vidéo

À partir des images clés, Runway (ou Kling, Pika, Luma) permet d’animer des séquences de 5 à 10 secondes. Selon la scène : image-to-video pour garder la cohérence visuelle (tu uploades l’image, tu décris le mouvement), ou text-to-video pour des plans plus libres (pas d’image source). Pour un comparatif détaillé, voir Runway, Kling et Pika, comparatif générateurs vidéo IA. Gère les limites : mains et visages peuvent être instables ; le lip-sync est encore limité sur la plupart des générateurs. Pour lip-sync et IA vidéo, limites et solutions, les contournements (éviter les plans parlants, ou utiliser des avatars dédiés) sont détaillés. Pour résoudre le flickering et la cohérence temporelle, les correctifs en post aident. Documente tes prompts et paramètres pour reproduire les résultats et pour les prochains projets. Pour workflow vidéo IA gratuit, tu peux combiner Luma, Veo et Grok si tu veux limiter les coûts.

Étape 4 : Post-production

- Upscaling : Passe les séquences en 4K avec TensorPix si la résolution de base est 720p ou 1080p et que tu veux un rendu 4K pour YouTube ou un livrable client. Teste d’abord sur un plan représentatif.

- Montage : CapCut pour assembler les plans, ajouter des keyframes (zooms, transitions), intégrer voix off (Google Studio, ElevenLabs) et bruitages. Les keyframes compensent l’absence de mouvement de caméra sur les images sources. Garde une piste voix, une piste bruitages, une piste musique. Pour sound design vidéo IA, le mix et les bonnes pratiques sont détaillés. Pour sous-titres automatiques vidéo, CapCut ou d’autres outils permettent de finaliser l’accessibilité.

Étape 5 : Export et diffusion

Exporte en 1080p ou 4K selon ton besoin (YouTube, Vimeo, court-métrage, client). Choisis le format (MP4 H.264 ou H.265) et le débit en fonction de la plateforme. Pense au chapitrage (timestamps) si tu publies sur YouTube, pour le SEO et l’UX. Pour workflow post-production vidéo IA DaVinci Resolve, les réglages d’export et le color grading sont détaillés si tu passes par DaVinci en fin de chaîne.

Tableau : étapes, outils, livrable

| Étape | Outils typiques | Livrable |

|---|---|---|

| Préproduction | Notebook LM, ChatGPT, feuille | Storyboard (liste de plans + descriptions) |

| Images clés | Midjourney, Leonardo, DALL·E | Images 16:9 cohérentes par plan |

| Animation | Runway, Kling, Luma, Veo | Clips 5–10 s par plan |

| Upscale | TensorPix (optionnel) | Clips 4K |

| Montage | CapCut, DaVinci | Timeline avec voix, son, keyframes |

| Export | CapCut, DaVinci | Fichier final 1080p/4K |

Scénarios réels

Scénario 1 : Court 2 min, ambiance Lovecraft. Thomas veut un court métrage atmosphérique (pas de dialogue). Il écrit un synopsis en 10 lignes, le découpe en 12 plans avec Notebook LM. Il génère 12 images avec Midjourney (style sombre, 35mm, film grain). Il anime chaque image avec Runway (image-to-video, mouvement lent). Il monte dans CapCut, ajoute une voix off (lecture d’un extrait de texte), une musique anxiogène et des bruitages. Il exporte en 1080p. Temps total : environ 2 semaines en travaillant à temps partiel. Pour ambiance visuelle court métrage fantastique Lovecraft, l’inspiration et les prompts sont détaillés.

Scénario 2 : Clip promo 30 s pour une marque. Sophie a un brief client : 30 s, ton premium, pas de dialogue, musique seule. Elle fait un storyboard de 8 plans (produit, environnement, détail). Elle génère les images avec Midjourney (style pub luxe), anime avec Runway. Elle monte dans CapCut, pose la musique (libre de droits), ajoute des keyframes de zoom sur les plans statiques. Elle livre en 1080p ; le client upscale en 4K côté post-pro. Pour publicités vidéo haute conversion, les leviers (rythme, CTA, cohérence) sont les mêmes.

Scénario 3 : Mini-doc 5 min, voix off. Marc veut un mini-documentaire sur un sujet local. Il rédige le script (voix off), le découpe en 20 plans. Il génère les images (lieux, archives, schémas) avec Midjourney et Leonardo. Il anime les plans nécessaires avec Luma (budget serré). Il enregistre sa voix (ou utilise ElevenLabs), monte dans CapCut, pose les sous-titres. Export 1080p pour YouTube. Pour créer sa première vidéo à partir de texte, la logique idée, script, visuels, montage est la même.

Ce que les débutants se trompent (et comment corriger)

Erreur 1 : Générer sans storyboard. Tu lances des images au hasard. Tu te retrouves avec des plans incohérents (style, lumière, ratio). Correction : Découpe l’histoire en plans avant de générer. Liste les plans avec une description courte. Génère dans l’ordre en gardant les mêmes mots-clés de style (cinematic, 35mm, film grain, etc.). Pour importance du storyboard généré IA, les bénéfices sont détaillés.

Erreur 2 : Incohérence visuelle entre les plans. Un plan en style cartoon, un autre photoréaliste. Correction : Réutilise le même type de prompt pour toute la série. Sur Midjourney, utilise le même style reference (--sref) ou le même seed si tu veux une cohérence très forte. Pour cohérence visuelle IA et LoRA, les techniques de stabilisation de style s’appliquent aussi au mini-film.

Erreur 3 : Oublier le son. Une vidéo sans voix ni musique semble brute. Correction : Intègre au minimum une voix off (script lu ou synthèse IA) et une musique de fond. Les bruitages (ambiance, impacts) renforcent l’immersion. Pour voix off réaliste en français et sound design vidéo IA, les workflows sont détaillés.

Erreur 4 : Plans trop longs sans mouvement. Un plan de 10 secondes sans zoom ni coupe fatigue. Correction : Ajoute des keyframes (zoom 100 % → 108 %) sur les plans de plus de 3–4 secondes. Ou coupe avec un insert (B-roll). Pour montage vidéo IA CapCut, les keyframes sont expliqués pas à pas.

Erreur 5 : Sous-estimer le temps et les coûts. Un mini-film de 3 min peut représenter 30–50 plans (images + animations), des dizaines de générations, du montage et du son. Correction : Estime le nombre de plans, le coût des crédits (Runway, Midjourney) et ton temps. Prévoyez des itérations : les premières versions ne sont pas toujours exploitables. Pour coûts et temps, l’ordre de grandeur est donné ci-dessous. Pour workflow vidéo IA gratuit, tu peux réduire les coûts en mixant Luma, Veo et Grok.

| Problème | Piste de solution |

|---|---|

| Flickering entre les plans | Stabiliser en post ; ou régénérer les plans problématiques ; voir résoudre le flickering |

| Rendu 720p seulement | Upscaler en 4K avec TensorPix après montage |

| Voix et image désynchronisées | Caler la voix sur la timeline ; couper ou étirer les plans pour suivre le rythme |

| Budget qui explose | Utiliser un workflow gratuit (Luma, Veo) pour une partie des plans ; limiter le nombre de régressions |

Pro tip : Garde un fichier « Making of » (liste des prompts, outils utilisés, paramètres) pour ton portfolio et pour reproduire le workflow sur le prochain projet. Pour workflow préproduction et storyboards IA, la documentation des choix créatifs fait partie des bonnes pratiques.

Coûts et temps (ordre de grandeur)

Les coûts dépendent des abonnements (Runway, Midjourney, TensorPix, ElevenLabs, etc.) et du nombre de générations. Un mini-film court (1–3 min) peut représenter quelques dizaines à quelques centaines d’euros en crédits + ton temps (1–3 semaines en temps partiel selon la complexité). Prévois des itérations : les premières versions ne sont pas toujours exploitables. Pour réduire les coûts, utilise un workflow vidéo IA gratuit (Luma, Veo, Grok) pour une partie des plans et réserve les outils payants pour les plans hero. Pour vendre une prestation vidéo IA, le même workflow peut être facturé 3 000 à 5 000 € selon le positionnement et le client.

Pour voir un mini-film réalisé avec l’IA et le making-of, la vidéo

MANGA animé avec l'IA - Créer une vidéo d'animation avec l'intelligence artificielle (ai)

montre un exemple concret. Tu y verras le rendu final et l’esprit « film 100 % IA ». Une ressource externe sur les bonnes pratiques de production vidéo : YouTube Creator Academy – Production (lien externe, non sponsorisé). Les principes (histoire, rythme, qualité son) s’appliquent aussi au mini-film IA.

Foire aux questions

Quel outil pour l’animation : Runway, Kling ou Luma ?

Runway (Gen-4, etc.) est très capable pour image-to-video et la cohérence des personnages. Kling pour des séquences un peu plus longues et un rendu cinéma. Luma pour du rapide et du budget (crédits gratuits). Veo 3.1 pour la qualité et le B-roll. Compare selon ton budget et tes besoins. Pour comparatif Runway Kling Pika et meilleurs générateurs vidéo IA 2026, les forces de chaque outil sont détaillées.

Faut-il obligatoirement Notebook LM pour le storyboard ?

Non. Tu peux utiliser ChatGPT, Claude, ou même une feuille et un crayon. L’important est d’avoir une liste de plans (numéro, type de plan, description, durée) avant de générer. Notebook LM est pratique car il peut analyser un document long (synopsis, notes) et en extraire un découpage. Pour workflow préproduction et storyboards IA, d’autres outils sont cités.

Comment garder la même esthétique sur tous les plans ?

Utilise les mêmes mots-clés dans chaque prompt (ex. « cinematic, 35mm, film grain, moody »). Sur Midjourney, le style reference (--sref) ou un seed commun peut figer l’esthétique. Sur Runway, une image de référence (même style) pour l’image-to-video aide. Pour seed et style reference Midjourney et cohérence visuelle IA, les techniques sont détaillées.

Puis-je faire un mini-film avec des dialogues (lip-sync) ?

C’est la partie la plus difficile. Les générateurs vidéo IA gèrent encore mal le lip-sync réaliste. Options : éviter les plans parlants (voix off seulement), ou utiliser des avatars (HeyGen, Synthesia) pour les personnages qui parlent et intégrer ces plans dans le montage. Pour lip-sync IA vidéo, limites et solutions et clonage vocal et avatars HeyGen Synthesia, les workflows sont détaillés.

Combien de temps pour un mini-film de 3 min ?

Ordre de grandeur : 1 à 3 semaines en temps partiel (selon le nombre de plans, les itérations et ton expérience). La préproduction (storyboard) prend 1–2 jours. La génération (images + animation) peut prendre 1–2 semaines si tu enchaînes les plans et que tu itères. Le montage et le son : 3–5 jours. Pour workflow vidéo IA gratuit, les quotas peuvent ralentir si tu dépends à 100 % du gratuit.

Faut-il upscaler en 4K pour YouTube ?

Non. YouTube accepte le 1080p. La 4K améliore la qualité perçue sur les grands écrans. Si tu veux un rendu 4K (client, diffusion pro), upscale après montage avec TensorPix. Pour un premier projet ou une démo, le 1080p suffit. Pour upscaling vidéo IA 4K, le flux est détaillé.

CapCut suffit-il pour le montage ou faut-il DaVinci ?

CapCut suffit pour la plupart des mini-films (assemblage, keyframes, voix, musique, sous-titres). DaVinci Resolve est utile si tu veux un color grading poussé, des effets VFX ou un workflow multicam. Pour montage vidéo IA CapCut et post-production vidéo IA DaVinci, les deux workflows sont décrits.

Comment diffuser mon mini-film ?

YouTube, Vimeo, site client, réseaux sociaux (extraits ou version courte). Pense aux formats : 16:9 pour YouTube/Vimeo, 9:16 pour Stories/Reels/Shorts. Tu peux exporter plusieurs versions depuis le même montage (recadrage ou projet dédié). Pour vidéo TikTok et Shorts IA, le format court et le rythme sont détaillés.

Sur le même thème sur ce site

Ces guides prolongent l’article sans répéter le même angle. Ils renforcent le maillage interne et aident à explorer le sujet en profondeur.

- Meilleures IA pour créer des vidéos

- Tutoriels vidé IA avancés

- Workflow débutant, de l’idée à la vidéo

- Panorama des outils IA

Sources et cadre officiel (lectures externes)

Renseignements généraux, droit et bonnes pratiques publiés par des institutions. À consulter selon votre situation et votre juridiction.

Frank Houbre - expert IA vidéo et Image

Frank Houbre est un expert en IA vidéo et image, artiste IA et filmmaker récompensé aux Seoul International AI Film Festival et aux Mondial Chroma Awards. Avec plus de 10 ans d'expérience en entrepreneuriat digital, il crée des courts-métrages et animés entièrement générés par IA (Midjourney, Kling, Adobe Firefly). Co-Fondateur de Screenweaver et de la communauté #AIStudios, il partage des tutoriels gratuits et avis d'outils sur Business Dynamite pour aider les créateurs à automatiser leur production.

Continuer la lecture

Créer une fausse bande-annonce de film d'action de A à Z

Workflow complet pour produire une fausse bande-annonce de film d'action en IA : script, découpage, génération des plans, montage, son.

Créer une bande-son originale pour sa vidéo avec Suno ou Udio

Générer une musique sur-mesure pour ta vidéo avec Suno ou Udio : prompts, durée, style et intégration dans le montage.

Créer une introduction musicale (jingle) pour sa chaîne YouTube

Générer un jingle court et mémorable pour l'intro de ta chaîne YouTube avec Suno, Udio ou des outils dédiés. Durée, style et intégration.

Créer un podcast audio interactif 100 % IA (script et voix)

Générer le script et les voix d'un podcast avec l'IA : outils, workflow et limites pour un podcast entièrement créé par intelligence artificielle.

Créer un documentaire historique avec de fausses archives IA

Méthode pour produire des fausses archives crédibles (photos, film 16 mm, documents) en IA et les intégrer dans un montage documentaire.

Créer des publicités type UGC (User Generated Content) 100% IA

Produisez des spots UGC ultra réalistes entièrement en IA. Workflows, prompts, lip-sync et intégration dans vos campagnes pub et réseaux sociaux.