Le glossaire de l'IA visuelle : 20 termes indispensables expliqués aux novices

Prompt, diffusion, seed, inpainting, B-Roll, ratio, upscale : 20 mots qui reviennent quand on parle d'images et de vidéos IA, définis simplement.

Tu lis un tutoriel sur Midjourney ou Runway. « Prompt », « seed », « inpainting », « ratio », « upscale ». Tu regardes une vidéo : « B-Roll », « cohérence temporelle », « image de référence ». Tu te sens un peu perdu. Ce glossaire est fait pour ça : 20 termes qui reviennent quand on parle d’IA visuelle (images et vidéos), avec une définition simple et un lien vers un article si tu veux aller plus loin. Pas pour tout mémoriser. Pour comprendre ce que tu lis et ce que tu fais. Pour mettre en pratique, voir comment faire un prompt pour une belle image, créer sa première vidéo IA et vocabulaire IA pour débutants.

Pour aller plus loin avec une demonstration pratique, cette video est directement liee au sujet.

IA Illimitée et Gratuite sur votre PC : Adieu Midjourney et Canva ?

1. Prompt

Le texte que tu envoies à un outil d’IA pour décrire ce que tu veux (une image, une vidéo, ou une réponse texte). Pour l’image et la vidéo, le prompt décrit la scène : sujet, lieu, style, lumière. Plus il est précis, plus le résultat a de chances de coller à ton intention. Voir qu’est-ce qu’un prompt, définition et 5 exemples.

2. Modèle

Le programme (le « moteur ») qui génère l’image ou la vidéo. Midjourney, DALL·E, Stable Diffusion, Runway Gen-4, Kling sont des noms de modèles ou d’outils qui les utilisent. Chaque modèle a ses forces et ses limites. Tu choisis un modèle via l’outil (Runway, Ideogram, etc.). Voir comment fonctionne une IA génératrice d’images.

3. Diffusion

Le principe utilisé par la plupart des générateurs d’images (et certains vidéo) : partir d’un bruit (pixels aléatoires) et le « débruiter » pas à pas en s’appuyant sur le prompt. Le modèle ne « dessine » pas, il transforme le chaos en structure. Voir comment fonctionne une IA génératrice d’images.

4. Génération

Le fait de produire une image ou une vidéo à partir d’un prompt (et éventuellement d’une image de départ). « Lancer une génération » = envoyer le prompt et attendre le résultat. Les outils limitent souvent le nombre de générations par jour ou par mois (quotas, crédits).

5. Image-to-image

Générer ou modifier une image à partir d’une image source + un prompt. Tu uploades une photo ou un visuel, tu décris ce que tu veux changer ou obtenir, l’outil produit une nouvelle image inspirée de la source. Utile pour des variations, du style transfer ou de la retouche pilotée par le texte. Voir modifier une photo existante avec l’IA.

6. Inpainting

Modifier une zone précise d’une image en gardant le reste intact. Tu sélectionnes une zone (masque), tu décris ce que tu veux à la place (prompt), l’outil regénère uniquement cette zone. Pratique pour corriger un détail (main, objet) ou remplacer un élément. Certains logiciels (Photoshop, InvokeAI, etc.) proposent cette fonction.

7. Outpainting

Agrandir une image au-delà de ses bords : tu demandes à l’IA de « prolonger » le contenu sur les côtés ou en haut/bas. Utile pour passer d’un format à un autre (ex. image carrée vers 16:9) ou pour étendre un décor. Voir prolonger une vidéo avec l’outpainting IA.

8. Seed

Une valeur numérique qui fixe le « hasard » au départ de la génération. Avec le même seed et le même prompt, tu peux retrouver exactement la même image ou vidéo. Utile pour reproduire un rendu ou itérer en ne changeant qu’un paramètre. Tous les outils ne proposent pas le réglage du seed.

9. Ratio (aspect ratio)

Le format de l’image ou de la vidéo : largeur par hauteur. Ex. 16:9 (paysage, YouTube), 9:16 (vertical, TikTok, Reels), 1:1 (carré), 4:3. Le ratio influence la composition. Il vaut mieux le choisir dès le départ selon la plateforme où tu publies. Voir ratio et impact narratif en création IA.

10. Style

La façon dont l’image ou la vidéo est rendue : réaliste, dessin, aquarelle, cinématique, anime, etc. Tu le précises dans le prompt (« style photo réaliste », « cinematic stills », « illustration »). Un seul style par prompt donne en général un rendu plus cohérent. Voir faire un prompt pour une belle image.

11. Image de référence (reference image)

Une image que tu fournis à l’outil pour qu’il s’en inspire (couleurs, composition, personnage, ambiance). Utile pour garder une cohérence entre plusieurs générations ou pour faire ressembler un personnage à une photo. Runway Gen-4, Midjourney et d’autres proposent cette option. Voir analyse image IA et poids des références visuelles et Runway Gen-4 et cohérence personnage.

12. Upscale / upscaling

Agrandir une image ou une vidéo en augmentant la résolution (nombre de pixels) avec l’IA. L’outil « invente » des détails pour que le rendu reste net. Utile pour passer d’une sortie basse résolution à un format affichable ou imprimable. Voir upscaling vidéo IA et upscaling images pour impression.

13. Résolution

Le nombre de pixels (largeur × hauteur) d’une image ou d’une vidéo. Ex. 1920×1080 (Full HD), 3840×2160 (4K). Plus la résolution est élevée, plus le fichier est lourd et plus le détail est fin. Les générateurs proposent souvent plusieurs résolutions de sortie ou un upscale ensuite.

14. B-Roll

Des plans de coupe : des images ou des vidéos qui illustrent ou complètent un plan principal (interview, voix off). En vidéo IA, on génère souvent des B-Rolls (ambiances, paysages, détails) pour les insérer dans un montage. Voir B-Roll cinématique avec Veo et Sora pour le B-Roll.

15. Frame

Une image fixe dans une séquence vidéo. Une vidéo est une suite de frames (ex. 24 ou 30 par seconde). En IA vidéo, le modèle génère des frames et les enchaîne. « Frame interpolation » = ajouter des images entre deux frames pour fluidifier (ralentis, ralenti). Voir frame interpolation pour fluidifier les ralentis IA.

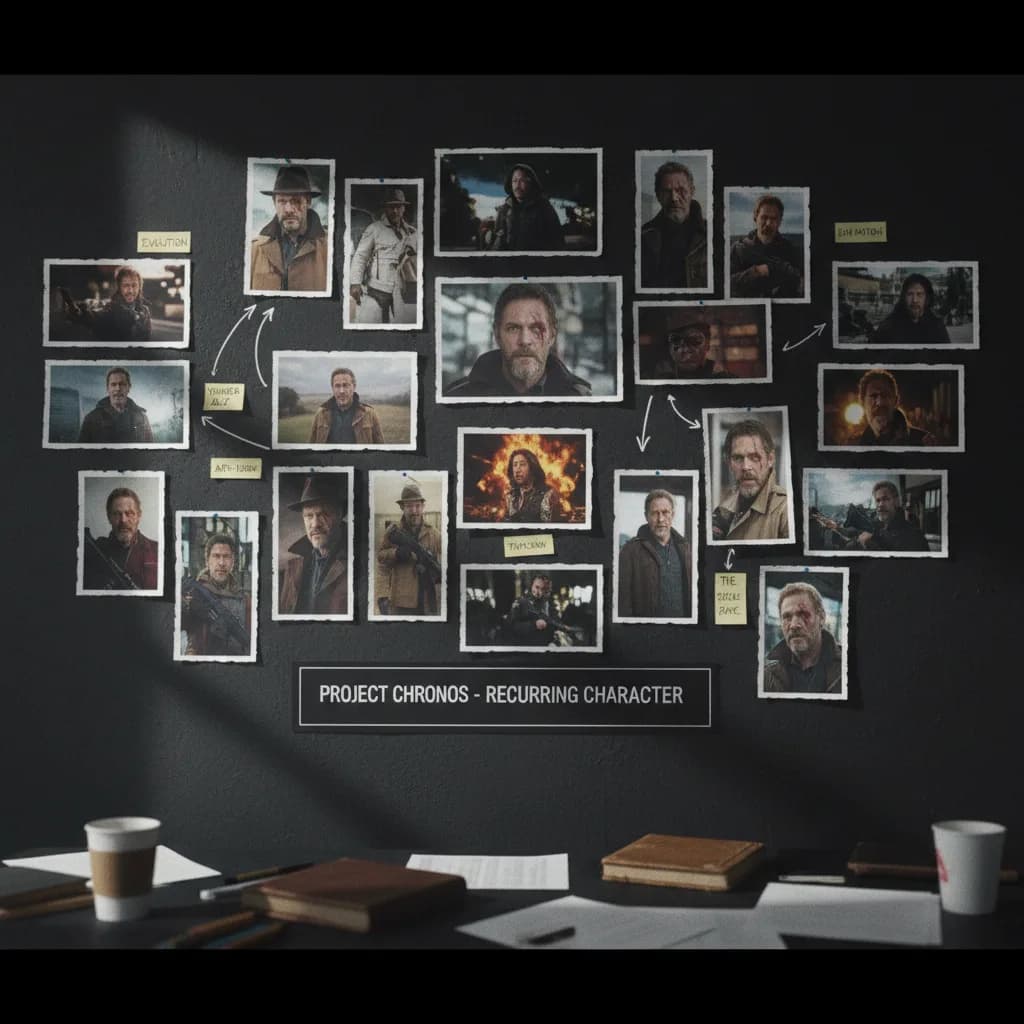

16. Cohérence (temporelle, personnage)

Cohérence temporelle : d’une frame à l’autre, la scène ne « saute » pas, les mouvements sont fluides. Cohérence personnage : le même personnage garde le même visage, les mêmes vêtements d’un plan à l’autre. Les générateurs progressent sur les deux, mais les erreurs (déformations, changement de visage) restent possibles. Une image de référence aide pour la cohérence personnage. Voir contraintes et limites génération vidéo et Runway Gen-4 et consistance personnages.

17. Cinematic / cinema photography

Des mots-clés souvent utilisés dans les prompts pour orienter le rendu vers un style cinéma (lumière travaillée, grain, profondeur de champ, cadrage type 35 mm). « Cinematic stills », « cinema photography », « natural film grain » sont courants dans les tutoriels. Voir prompts éclairage cinématographique et créer sa première vidéo IA.

18. Negative prompt

Une description de ce que tu ne veux pas dans l’image ou la vidéo. Certains outils (Stable Diffusion, quelques interfaces) ont un champ « negative prompt » : tu y mets par ex. « flou, déformé, doigts en trop ». Le modèle essaie d’éviter ces éléments. Tous les générateurs ne proposent pas cette option. Voir importance du negative prompt pour limiter les aberrations.

19. Crédits / quotas

Les limites imposées par la plateforme : nombre de générations par jour ou par mois, ou nombre de secondes de vidéo. Les offres gratuites ont des quotas réduits ; les abonnements en donnent plus. « Crédits » ou « secondes » s’affichent souvent dans l’interface. Voir IA gratuite vs payante et contraintes et limites génération vidéo.

20. Cloud

Le calcul se fait sur les serveurs du fournisseur (Runway, Midjourney, etc.), pas sur ton ordinateur. Tu envoies ton prompt depuis ton PC ou ton téléphone, tu reçois le résultat. Tu n’as pas besoin d’un PC puissant. En local, au contraire, le calcul se fait sur ta machine (ex. Stable Diffusion sur ton GPU). Voir matériel vidéo IA, ordinateur ou cloud et quel matériel pour l’IA.

Tableau récap : les 20 termes

| Terme | En une phrase |

|---|---|

| Prompt | Texte que tu envoies pour décrire ce que tu veux (image, vidéo). |

| Modèle | Programme qui génère l’image ou la vidéo (ex. Runway Gen-4, Stable Diffusion). |

| Diffusion | Principe : partir du bruit, débruiter en suivant le prompt. |

| Génération | Produire une image ou une vidéo à partir d’un prompt. |

| Image-to-image | Générer ou modifier à partir d’une image source + prompt. |

| Inpainting | Modifier uniquement une zone sélectionnée de l’image. |

| Outpainting | Prolonger l’image au-delà de ses bords. |

| Seed | Valeur qui fixe le hasard pour reproduire un rendu. |

| Ratio | Format (16:9, 9:16, 1:1, etc.). |

| Style | Façon de rendre (réaliste, cinéma, dessin, etc.). |

| Image de référence | Image fournie pour s’en inspirer (cohérence, personnage). |

| Upscale | Agrandir la résolution avec l’IA. |

| Résolution | Nombre de pixels (largeur × hauteur). |

| B-Roll | Plans de coupe pour illustrer ou compléter une séquence. |

| Frame | Image fixe dans une vidéo. |

| Cohérence | Continuité temporelle ou du personnage entre les plans. |

| Cinematic | Mots-clés pour un rendu type cinéma. |

| Negative prompt | Description de ce qu’on ne veut pas dans le rendu. |

| Crédits / quotas | Limites de générations ou de secondes par la plateforme. |

| Cloud | Calcul sur les serveurs du fournisseur, pas sur ta machine. |

En résumé

Ces 20 termes reviennent dès qu’on parle d’IA visuelle (images et vidéos). Les connaître te permet de lire les tutoriels et de paramétrer les outils sans rester bloqué. Pour aller plus loin, vocabulaire IA pour débutants, grand dictionnaire de l’IA et lexique des 50 mots à connaître couvrent aussi le texte et les concepts généraux.

Foire aux questions

Où trouver des définitions pour d’autres termes (texte, LLM, token) ?

Voir vocabulaire IA pour débutants, grand dictionnaire de l’IA et lexique des 50 mots à connaître. Ces articles couvrent le prompt texte, le contexte, le modèle, le token, l’hallucination, etc.

Qu’est-ce que le « negative prompt » en pratique ?

C’est une zone de texte où tu décris ce que tu ne veux pas dans l’image (flou, déformé, doigts en trop, texte parasite). Certains outils (Stable Diffusion, ComfyUI, etc.) l’utilisent pour réduire les défauts. Midjourney et Runway n’ont pas toujours ce champ ; tu peux parfois inclure des interdictions dans le prompt principal (« no text », « hands not visible »). Voir negative prompt et aberrations anatomiques.

Seed et reproductibilité : tous les outils le proposent-ils ?

Non. Stable Diffusion et beaucoup d’outils locaux ou avancés permettent de fixer un seed. Runway, Midjourney, Luma ne l’affichent pas toujours ou ne le proposent qu’en mode avancé. Consulter la doc de chaque outil.

Quelle différence entre image-to-image et inpainting ?

,

B-Roll et « plan principal », c’est quoi ?

Le plan principal (A-Roll) est souvent l’élément central (interview, personne qui parle). Les B-Roll sont les plans qui illustrent, aèrent ou complètent (paysages, détails, ambiances). En vidéo IA, on génère souvent des B-Rolls pour les insérer dans un montage. Voir B-Roll cinématique.

Upscale : ça dégrade la qualité ?

Non. L’upscale IA ajoute des pixels en « devinant » les détails pour garder une image nette. Le résultat peut être plus net qu’une simple mise à l’échelle. La qualité dépend du modèle d’upscale utilisé. Voir upscaling vidéo IA et Magnific AI.

Cloud vs local : lequel choisir ?

,

Où apprendre à utiliser ces termes en pratique ?

Pour l’image : faire un prompt pour une belle image et prompt parfait images photoréalistes. Pour la vidéo : créer sa première vidéo IA et meilleurs générateurs vidéo IA 2026. Pour le vocabulaire général : IA pour les vrais débutants.

Ressource externe recommandee

Prompt Engineering Guide, bonnes pratiques et exemples actionnablesLe meilleur resultat vient d'un workflow simple, teste, puis repete avec des ajustements concrets.

Votre avis

Chargement…

Sur le même thème sur ce site

Ces guides prolongent l’article sans répéter le même angle. Ils renforcent le maillage interne et aident à explorer le sujet en profondeur.

Voir tous les articles « Images IA »

- Meilleures IA pour générer des images

- Prompts images photoréalistes, qualité studio

- Premiers pas avec Midjourney

- Guide complet pour débuter en IA

Articles proches sur le blog

Suggestions basées sur la catégorie, les mots du titre et le sujet, pour prolonger la lecture sans dupliquer les piliers ci-dessus.

- Comment créer un personnage récurrent crédible avec une IA d'image

- Comment écrire de meilleurs prompts Midjourney pour un rendu plus cinématographique

- Midjourney vs DALL-E 3 : Lequel est le plus simple à prendre en main ?

- 5 prompts faciles à copier-coller pour générer un portrait photo-réaliste

Sources et cadre officiel (lectures externes)

Renseignements généraux, droit et bonnes pratiques publiés par des institutions. À consulter selon votre situation et votre juridiction.

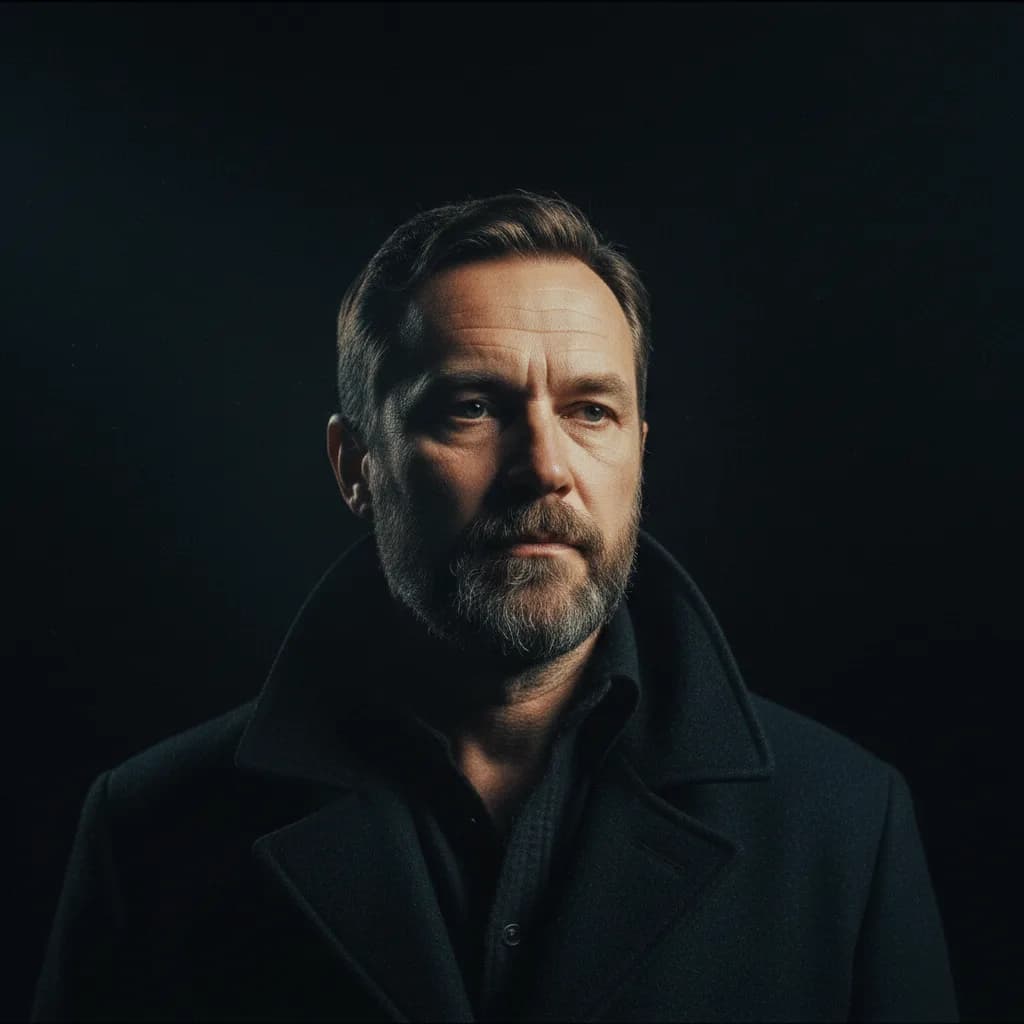

Frank Houbre - expert IA vidéo et Image

Frank Houbre est un expert en IA vidéo et image, artiste IA et filmmaker récompensé aux Seoul International AI Film Festival et aux Mondial Chroma Awards. Avec plus de 10 ans d'expérience en entrepreneuriat digital, il crée des courts-métrages et animés entièrement générés par IA (Midjourney, Kling, Adobe Firefly). Co-Fondateur de Screenweaver et de la communauté #AIStudios, il partage des tutoriels gratuits et avis d'outils sur Business Dynamite pour aider les créateurs à automatiser leur production.

Continuer la lecture

Comment créer un personnage récurrent crédible avec une IA d'image

Masterclass complète pour créer un personnage récurrent crédible avec une IA d'image, méthode terrain, réglages précis, erreurs fréquentes et corrections pro.

Comment écrire de meilleurs prompts Midjourney pour un rendu plus cinématographique

Masterclass debutant complete pour prompts cinématographiques, avec methode concrete, reglage par reglage, erreurs frequentes et corrections techniques actionnables.

Midjourney vs DALL-E 3 : Lequel est le plus simple à prendre en main ?

Comparatif honnête simplicité : Discord et /imagine vs ChatGPT en langage naturel. Courbe d'apprentissage, premiers clics, pièges débutant et choix selon ton profil.

5 prompts faciles à copier-coller pour générer un portrait photo-réaliste

Cinq formulations prêtes à l'emploi pour des portraits IA photoréalistes : studio, naturel, cinéma, avec les mots-clés qui marchent.

Agrandir une petite image sans la pixeliser : Les solutions gratuites

Upscaling IA gratuit : quels outils utiliser, comment les utiliser, et ce qu'on peut vraiment attendre sans payer.

Changer la couleur des vêtements sur une photo grâce à l'IA

Recoloriser une tenue sur une photo : outils (Canva, Photoroom, Photoshop IA), workflow et pièges à éviter.