Les "Style References" : Comment copier la patte graphique d'une image

Vous avez une image dont vous aimez le style. Couleurs, grain, lumière. Les style references permettent d'appliquer cette patte à vos nouvelles générations. Guide pratique.

Vous tombez sur une image. Une photo, une frame de film, une illustration. Les couleurs, le grain, la lumière vous parlent. Vous voulez la même patte sur vos propres visuels. Sans refaire le prompt au hasard. Les style references (ou « image reference », « style ref ») sont faites pour ça : vous donnez une ou plusieurs images au générateur en plus de votre texte, et il extrait leur esthétique pour l’appliquer à ce que vous demandez. Sujet et composition peuvent changer. Le look reste. Ce guide explique comment ça marche, où l’utiliser (Midjourney, Stable Diffusion, Runway, etc.) et comment éviter les pièges. Pour Midjourney en particulier, Seed, Style Reference et sref détaille --sref. Pour garder des résultats réguliers en plus du style, paramètre Seed pour des résultats réguliers complète.

Pour aller plus loin avec une demonstration pratique, cette video est directement liee au sujet.

Générer des Images IA : Le Guide COMPLET pour Débuter

Style reference : c’est quoi en une phrase ?

Une style reference est une image que vous fournissez au générateur en entrée, en plus de votre prompt texte. Le moteur analyse cette image (couleurs, contraste, grain, ambiance) et injecte ces caractéristiques dans la génération. Vous ne copiez pas l’image. Vous réutilisez son style sur un nouveau sujet, un nouveau cadrage, une nouvelle scène. Pense plutot comme ca, comme un directeur photo qui montre une référence visuelle à son équipe. « Je veux ce type de lumière, ces tons, ce grain. » Le style reference fait passer cette intention à l’IA. Pour des visuels cohérents en série, générer des visuels publicitaires cohérents et Instagram feed cohérent à l’IA donnent des workflows complets.

Où et comment l’utiliser ?

Midjourney : --sref

Sur Midjourney, vous uploadez une image (ou vous utilisez l’URL d’une image déjà sur le serveur). Vous ajoutez à la fin de votre prompt : --sref [URL]. Exemple : A woman in a café, rainy window, cinematic --sref https://.... Midjourney prend l’esthétique de l’image (couleurs, grain, contraste) et l’applique à « woman in a café, rainy window, cinematic ». Vous pouvez parfois passer plusieurs URLs (--sref URL1 URL2) pour mélanger deux styles ; le résultat est moins prévisible. Pour le détail, Seed et sref sur Midjourney.

Stable Diffusion, Fooocus, ComfyUI

Selon l’interface, vous avez un champ « Image » ou « Reference » où vous glissez une image. Parfois c’est couplé à un ControlNet ou à un mode img2img avec un poids faible sur l’image (pour garder le style sans copier le contenu). Les noms varient : « style reference », « reference image », « input image ». En général, vous uploadez l’image de référence et vous rédigez le prompt qui décrit la nouvelle scène. Le modèle mélange les deux. Consultez la doc de votre interface (Fooocus, ComfyUI, A1111) pour le paramètre exact.

Runway (vidéo)

Pour la vidéo, Runway et d’autres outils proposent parfois une image de référence pour le style (couleurs, ambiance) ou pour la première frame. Vous uploadez une image et vous demandez une vidéo qui en prolonge l’ambiance ou le mouvement. Pour la cohérence entre plans, coherence visuelle et LoRA et storyboard première vidéo IA aident.

Workflow concret : une image pilote, puis une série

Étape 1. Générez ou choisissez une image qui définit le look (lumière, palette, grain). C’est votre référence pilote.

Étape 2. Récupérez son URL (Midjourney : clic droit sur l’image, copier l’adresse) ou gardez le fichier (Stable Diffusion, Fooocus).

Étape 3. Pour chaque nouvelle image, écrivez le prompt qui décrit le sujet et la scène (pas besoin de redécrire le style en détail). Ajoutez la style reference : --sref [URL] sur Midjourney, ou uploadez l’image dans le champ prévu sur les autres outils.

Étape 4. Gardez dans le prompt des termes de style cohérents avec la référence (ex. « cinematic stills, 35mm, film grain ») pour renforcer l’effet. Lancez. Les sorties devraient partager la même patte graphique.

Étape 5. Si une image dérive (trop lumineuse, couleurs différentes), vérifiez que la référence est bien prise en compte et que le prompt ne contient pas de termes contradictoires (ex. « bright neon » alors que la ref est low key).

Pro tip : Pour une campagne ou un moodboard, générez d’abord une image qui vous satisfait. Utilisez-la comme seule référence pour toutes les suivantes. Vous gardez une cohérence forte. Pour varier plus tard, changez de référence ou mélangez deux refs (quand l’outil le permet). Pour écrire des prompts adaptés, ChatGPT pour écrire le prompt image et contrôler la lumière avec ses prompts complètent.

Ce que les débutants se trompent

Erreur 1 : Confondre style reference et « copier l’image »

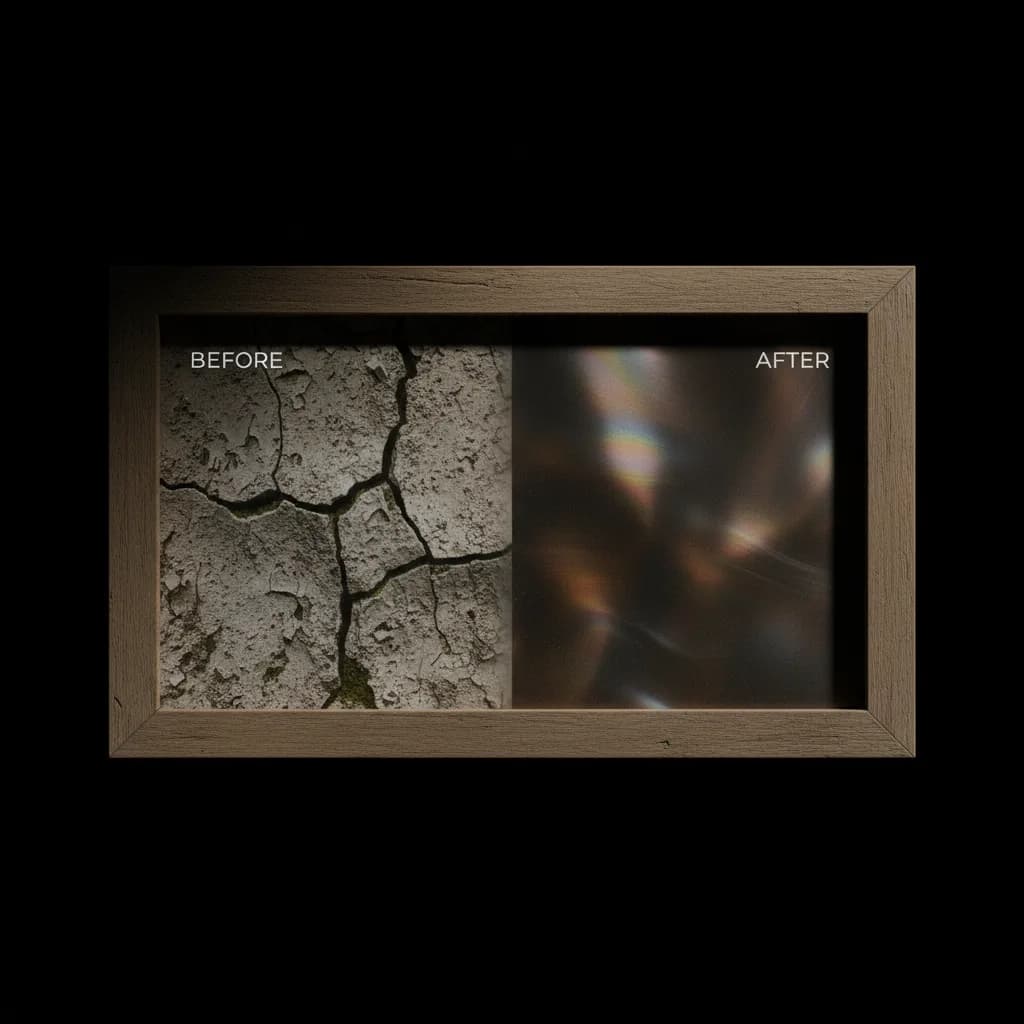

La style ref ne reproduit pas l’image. Elle en extrait le style (couleurs, grain, ambiance) et l’applique à un nouveau contenu. Si votre prompt décrit une scène très différente, vous obtiendrez cette scène avec l’esthétique de la référence. Correction : Utiliser la ref pour le look, et le prompt pour le sujet et la composition.

Erreur 2 : Mettre une référence qui contredit le prompt

Si la ref est sombre et désaturée et que vous écrivez « bright, saturated, neon », le modèle hésite. Correction : Aligner le prompt avec la référence (« moody, low key, film grain ») pour un rendu cohérent.

Erreur 3 : Trop de références à la fois

Certains outils permettent plusieurs images. Mélanger 3 ou 4 styles donne souvent un résultat flou ou imprévisible. Correction : Une seule référence par série, ou deux maximum si vous voulez fusionner deux ambiances. Tester et comparer.

Erreur 4 : Mauvaise résolution ou image trop petite

Une ref très petite ou très compressée peut donner moins de détail de style. Correction : Utiliser une image en résolution correcte (au moins 512–1024 px de côté selon l’outil). Éviter les captures écran floues.

Tableau récap

| Outil | Comment ajouter une style reference |

|---|---|

| Midjourney | Upload image ou URL, puis --sref [URL] à la fin du prompt |

| Stable Diffusion / Fooocus | Champ « Reference image » ou « Input image », selon l’interface |

| Runway (vidéo) | Image de référence pour le style ou la première frame, selon le mode |

| DALL·E / Ideogram | Pas toujours disponible ; vérifier « image input » ou « style from image » |

Scénarios réalistes

Scénario A : Vous devez faire 6 visuels pour une campagne. Vous voulez la même lumière et la même palette sur tous. À faire : Générer une image pilote qui valide le look. Récupérer son URL. Pour les 5 autres, écrire le prompt de chaque scène (produit, personnage, lieu) et ajouter --sref [URL pilote] (Midjourney). Garder les mêmes termes de style dans chaque prompt. Vous obtenez une série cohérente. Voir visuels publicitaires cohérents.

Scénario B : Vous avez une photo ou une frame de film que vous aimez. Vous voulez générer une nouvelle image (autre lieu, autre personnage) dans le même style. À faire : Uploadez la photo (ou son URL si l’outil l’accepte). Rédigez le prompt qui décrit la nouvelle scène. Ajoutez la ref. Lancez. Ajustez le prompt si le style n’est pas assez fort (renforcer les termes : « cinematic, 35mm, same color palette »).

Scénario C : Vous faites un storyboard vidéo. Chaque plan doit partager la même esthétique. À faire : Créer une image de référence pour le premier plan (ou une frame de référence). L’utiliser comme style ref pour les plans suivants (Runway, ou génération image par image). Pour structurer le storyboard, créer le storyboard de sa première vidéo IA de A à Z et importance du storyboard avant création vidéo.

Ressource externe

Pour la doc officielle Midjourney sur les paramètres dont --sref : Midjourney Parameter List.

Foire aux questions

Qu’est-ce qu’une style reference ?

C’est une image que vous donnez au générateur en plus de votre prompt. Le moteur en extrait l’esthétique (couleurs, grain, lumière) et l’applique à la scène décrite par le prompt. Le sujet peut changer, le style reste.

Où l’utiliser ?

Midjourney : --sref [URL]. Stable Diffusion, Fooocus, ComfyUI : champ « Reference image » ou équivalent. Runway (vidéo) : image de référence pour le style ou la première frame. DALL·E, Ideogram : vérifier si une option « image input » ou « style from image » existe.

Style reference et seed, quelle différence ?

Le seed sert à reproduire ou varier une même génération (même prompt, même point de départ). La style reference sert à transférer le style d’une image (souvent différente) sur de nouvelles scènes. Pour une série, on combine souvent les deux : une ref pour le look, le seed pour rejouer une image précise. Voir paramètre Seed et Seed et sref Midjourney.

Puis-je utiliser une image que je n’ai pas générée ?

Oui, en général. Vous uploadez n’importe quelle image (photo, frame de film, illustration). Le modèle en extrait le style. Attention au droit d’auteur si vous exploitez commercialement : la ref inspire le rendu, le contenu généré reste nouveau, mais vérifiez les CGU de l’outil et vos usages.

Pourquoi le style ne « prend » pas bien ?

Vérifiez que le prompt ne contredit pas la référence (ex. « bright » alors que la ref est sombre). Utilisez une ref en bonne résolution. Renforcez le style dans le prompt avec les mêmes termes (cinematic, 35mm, film grain, etc.).

Plusieurs références en même temps ?

Certains outils (ex. Midjourney avec --sref URL1 URL2) permettent de mélanger deux styles. Le résultat est moins prévisible. Pour une série cohérente, une référence est souvent plus efficace.

Votre avis

Chargement…

Sur le même thème sur ce site

Ces guides prolongent l’article sans répéter le même angle. Ils renforcent le maillage interne et aident à explorer le sujet en profondeur.

Voir tous les articles « Images IA »

- Meilleures IA pour générer des images

- Prompts images photoréalistes, qualité studio

- Premiers pas avec Midjourney

- Guide complet pour débuter en IA

Articles proches sur le blog

Suggestions basées sur la catégorie, les mots du titre et le sujet, pour prolonger la lecture sans dupliquer les piliers ci-dessus.

- Flux et Crea , Comment Modifier la Texture et le Style d'une Image IA

- Analyse d'image , Comment l'IA interprète le poids des références visuelles

- Reconnaître une image IA d'une vraie photo : Les détails qui trompent

- Mon image fait "trop IA" : Comment ajouter du grain et des imperfections

Sources et cadre officiel (lectures externes)

Renseignements généraux, droit et bonnes pratiques publiés par des institutions. À consulter selon votre situation et votre juridiction.

Frank Houbre - expert IA vidéo et Image

Frank Houbre est un expert en IA vidéo et image, artiste IA et filmmaker récompensé aux Seoul International AI Film Festival et aux Mondial Chroma Awards. Avec plus de 10 ans d'expérience en entrepreneuriat digital, il crée des courts-métrages et animés entièrement générés par IA (Midjourney, Kling, Adobe Firefly). Co-Fondateur de Screenweaver et de la communauté #AIStudios, il partage des tutoriels gratuits et avis d'outils sur Business Dynamite pour aider les créateurs à automatiser leur production.

Continuer la lecture

Flux et Crea , Comment Modifier la Texture et le Style d'une Image IA

Modifier texture et style d'une image générée par IA avec Flux et Crea : post-génération chirurgicale sans refaire toute la composition.

Analyse d'image , Comment l'IA interprète le poids des références visuelles

Image reference, style reference, ControlNet : comprendre comment le moteur combine ton image et ton texte pour ne plus avoir de surprises.

Reconnaître une image IA d'une vraie photo : Les détails qui trompent

Comment distinguer une image générée par IA d'une vraie photo ? Les indices visuels, les outils de détection, et pourquoi c'est de plus en plus difficile.

Mon image fait "trop IA" : Comment ajouter du grain et des imperfections

Vos images IA ont un look plastique et trop parfait ? Techniques pour ajouter du grain, des imperfections, et un rendu plus authentique et cinématographique.

Demander à ChatGPT d'écrire le prompt image parfait à votre place

Vous avez l'idée, pas les mots. ChatGPT peut rédiger le prompt pour Midjourney, DALL·E ou Stable Diffusion. Voici comment le brief correctement et récupérer un prompt exploitable.

Comment tarifer une prestation de vidéo ou d'image IA à un client

Tarifier ses prestations créatives IA : vidéo, image, voix off. Méthodes de prix, facteurs à prendre en compte et pièges à éviter.